В начале 2025 года индустрия искусственного интеллекта столкнулась с беспрецедентным событием. Правительство США признало компанию Anthropic, создателя модели Claude, угрозой национальной безопасности в цепочке поставок. Это первый случай применения подобного статуса к американской компании. Причиной стал не технический сбой, а принципиальный отказ разработчиков передать военным полный контроль над своей технологией без этических ограничений.

Anthropic изначально позиционировала себя как лабораторию с максимальным фокусом на безопасности. В феврале 2025 года компания задержала релиз модели Claude 3.7 Sonnet на 10 дней из-за опасений своей «красной команды» (red team) относительно того, что система может помочь в создании биологического оружия. При оценке в 380 миллиардов долларов и недавнем привлечении 30 миллиардов инвестиций, компания стала ключевым игроком на рынке, чьи технологии меняют подход к программированию и анализу данных.

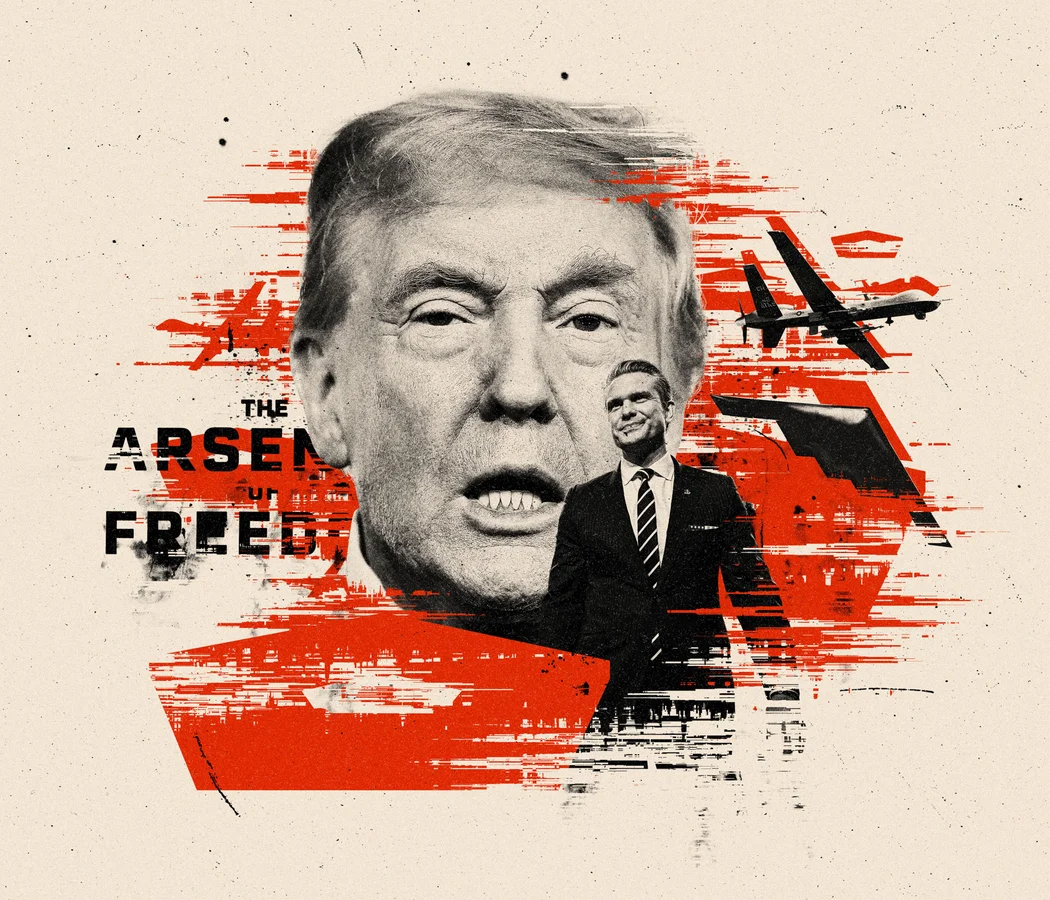

Конфликт с Пентагоном разгорелся вокруг условий контракта. Модель Claude уже использовалась правительством, однако генеральный директор Дарио Амодей отказался убрать базовые ограничения системы. Он настаивал на двух правилах: ИИ не должен управлять полностью автономными системами вооружения и не должен использоваться для массовой слежки за гражданами США.

В ответ Министерство обороны заявило, что частная компания не может диктовать условия ведения боевых действий. Администрация президента запретила использование программного обеспечения Anthropic в государственных структурах. Освободившуюся нишу быстро заняла конкурирующая OpenAI, подписав военный контракт.

Этот случай выходит за рамки обычного корпоративного спора. Он ставит фундаментальный вопрос: кто должен определять границы применения передовых технологий — разработчики, создающие их, или государство, использующее их для национальной безопасности. Руководство Anthropic заявляет о политическом давлении. Представители Пентагона утверждают, что непредсказуемые ограничения (guardrails) в ИИ ставят под угрозу эффективность военных операций и несовместимы с армейской субординацией.

9 марта Anthropic подала в суд на правительство, пытаясь оспорить внесение в черный список. Парадоксально, но этичное поведение привлекло к компании новых корпоративных клиентов, которые начали массово переходить на Claude. Период до 2030 года станет определяющим для индустрии: модели становятся мощнее, а ставки в борьбе за контроль над ними повышаются до уровня государственной безопасности.