Автономное сжатие контекста: как ИИ-агенты учатся управлять собственной памятью

Разработчики добавили в Deep Agents SDK инструмент, позволяющий языковым моделям самостоятельно определять оптимальное время для сжатия своего контекстного окна.

Разработчики добавили в Deep Agents SDK инструмент, позволяющий языковым моделям самостоятельно определять оптимальное время для сжатия своего контекстного окна.

3 мин

Команда разработчиков представила новый инструмент для Deep Agents SDK и интерфейса командной строки (CLI). Теперь искусственные агенты могут самостоятельно инициировать сжатие своего контекстного окна в наиболее подходящие для этого моменты. Это решение меняет традиционный подход к управлению рабочей памятью больших языковых моделей (LLM), передавая контроль от жестких алгоритмов самим нейросетям.

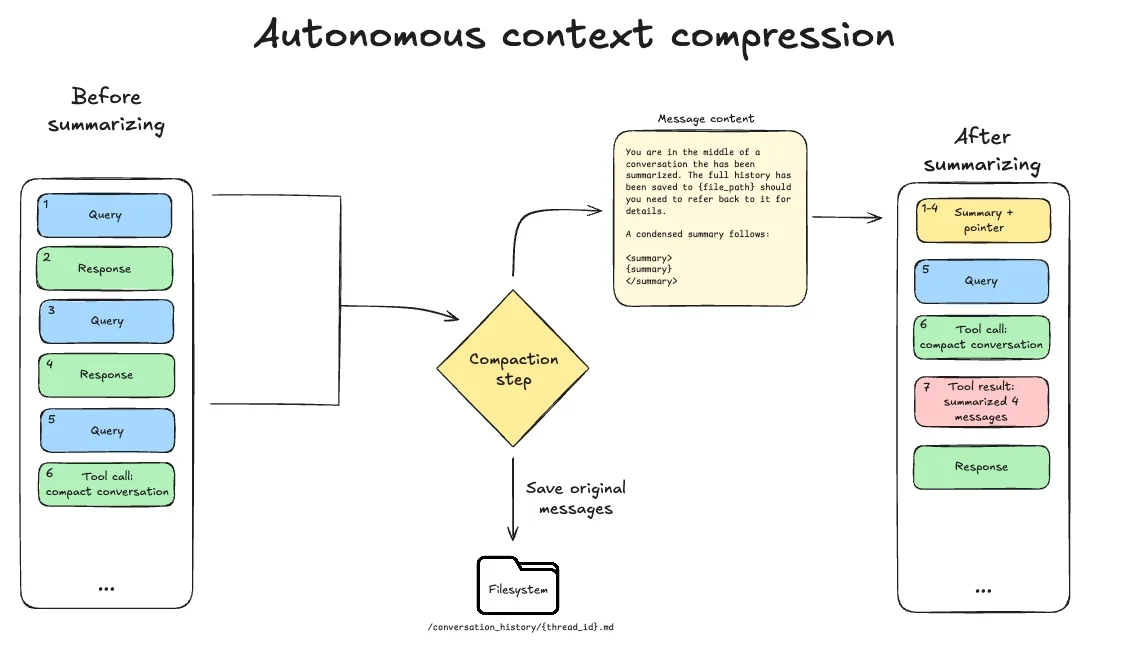

Сжатие контекста — это базовая операция, которая уменьшает объем информации в рабочей памяти агента. По мере общения старые сообщения заменяются кратким резюме, которое сохраняет суть прогресса, необходимого для выполнения задачи. Это действие критически важно из-за ограниченного размера контекстного окна моделей и явления "гниения контекста" (context rot), когда обилие устаревшей информации начинает сбивать модель с толку.

Исторически системы управления агентами (harnesses) контролировали этот процесс с помощью фиксированных порогов. Например, стандартный профиль мог запускать очистку, когда заполнялось 85% доступного лимита токенов. Однако такой дизайн далек от идеала. Автоматика может запустить сжатие в самом разгаре сложного изменения программного кода, когда важна каждая деталь, вместо того чтобы сделать это при переходе к новой задаче.

Новый инструмент реализован как промежуточное программное обеспечение (middleware) в Deep Agents SDK. Когда агент решает вызвать инструмент сжатия, система сохраняет последние сообщения (около 10% от доступного контекста), а всю предшествующую переписку превращает в сжатое резюме.

Изображение из источника

В системном промпте модели даются инструкции о том, когда именно стоит применять этот инструмент. Оптимальные сценарии включают:

Это нововведение является отличной иллюстрацией так называемого "горького урока" (the bitter lesson) в исследованиях искусственного интеллекта. Суть этого принципа в том, что общие методы, использующие вычислительные мощности и возможности самих моделей, в долгосрочной перспективе всегда побеждают подходы, основанные на жестких правилах, написанных человеком.

Вместо того чтобы разработчики пытались предусмотреть все возможные сценарии и вручную настраивать пороги срабатывания для каждого отдельного приложения, система просто делегирует эту задачу агенту. Тестирование показало, что модели ведут себя консервативно и не злоупотребляют функцией, но когда они ее используют, это происходит в моменты, действительно улучшающие рабочий процесс.

Автономное сжатие контекста — это относительно небольшая функция, но она указывает на более широкое направление в проектировании ИИ-агентов. Будущее архитектуры агентов движется в сторону предоставления моделям большей автономии над своими внутренними процессами.

ИИ-агенты получили возможность самостоятельно определять моменты для сжатия своей рабочей памяти, отказываясь от жестких лимитов, установленных разработчиками.

Передача контроля над системными процессами самой языковой модели оказывается эффективнее, чем попытки инженеров написать идеальные правила для управления памятью.

По мере развития способностей моделей к рассуждению, мы будем видеть все меньше жестких, настроенных вручную правил в системах управления. Разработчики смогут сосредоточиться на создании качественных инструментов, а то, как и когда их применять, ИИ будет решать самостоятельно, опираясь на текущую ситуацию и здравый смысл.