Как правильно оценивать навыки AI-агентов: опыт LangChain

Команда LangChain делится методологией тестирования «навыков» для кодинг-агентов. Почему просто добавить инструкции недостаточно и как построить надежный пайплайн оценки.

Команда LangChain делится методологией тестирования «навыков» для кодинг-агентов. Почему просто добавить инструкции недостаточно и как построить надежный пайплайн оценки.

3 мин

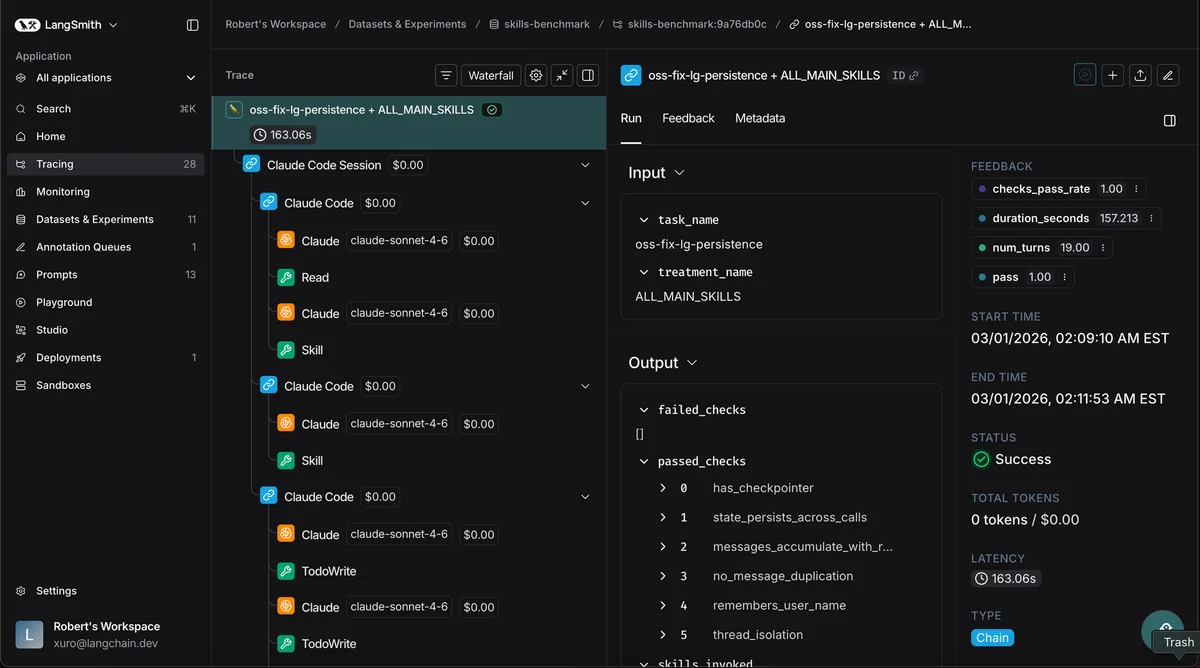

В индустрии разработки AI-агентов происходит важный сдвиг. Если раньше мы просто давали моделям доступ к инструментам и надеялись на лучшее, то теперь фокус смещается на создание специализированных «навыков» (skills) и, что еще важнее, на строгую оценку их эффективности. Команда LangChain опубликовала подробный разбор того, как они тестируют навыки для таких агентов, как Claude Code.

«Навыки» в контексте агентов — это набор инструкций, скриптов и ресурсов, которые загружаются динамически. Ключевое слово здесь — динамически. Исторически сложилось так, что если дать агенту слишком много инструментов сразу, его производительность падает: модель «теряется» в контексте. Поэтому навыки должны подгружаться только тогда, когда они релевантны текущей задаче.

Но как понять, действительно ли добавленный навык помогает, а не сбивает агента с толку? LangChain предлагает четырехступенчатый процесс оценки.

Агенты, пишущие код, чрезвычайно чувствительны к начальным условиям. Если запустить Claude Code в папке с «мусором» от предыдущих проектов, его поведение изменится. Он начнет изучать существующие файлы и подстраиваться под них.

Изображение из источника

Поэтому критически важно использовать изолированные среды. LangChain рекомендует запускать агентов в Docker-контейнерах или специальных «песочницах». Это гарантирует воспроизводимость результатов: каждый тест начинается с чистого листа.

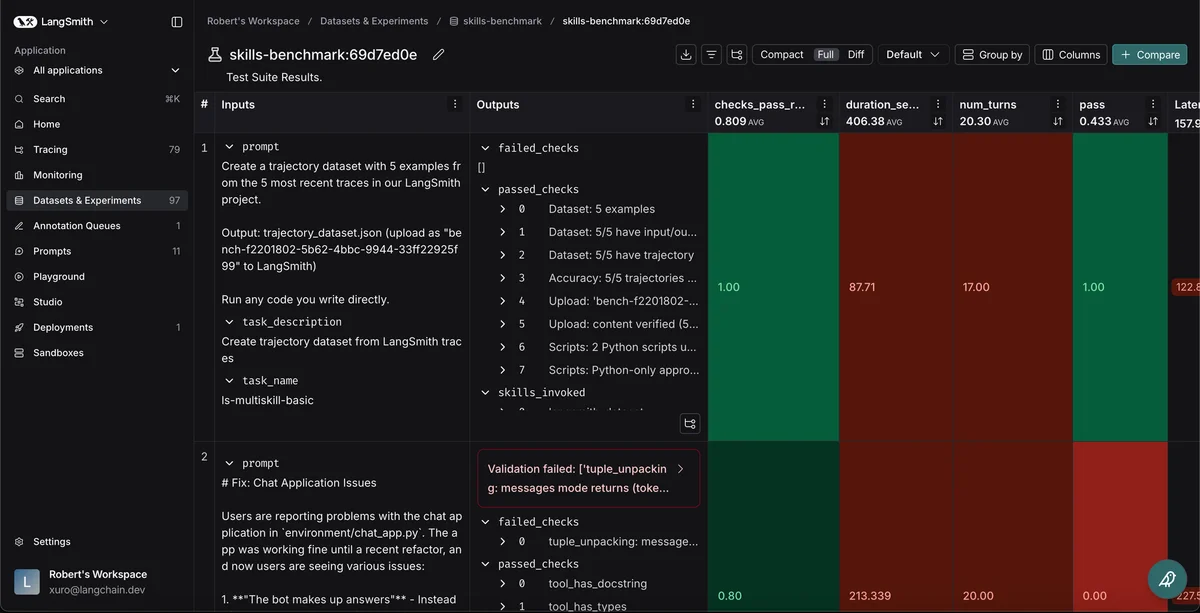

Оценка «на глаз» (vibes) здесь не работает. Нужны конкретные задачи. При этом важно не делать задачи слишком открытыми. Например, просьба «создать исследовательского агента» слишком размыта — результат трудно оценить автоматически.

Лучше работают задачи на исправление ошибок (bug fixing) или создание чего-то по жесткой спецификации. Это сужает пространство решений и позволяет программно проверить результат.

Метрики, которые стоит отслеживать:

Интересное наблюдение: агенты не всегда догадываются использовать нужный навык. Даже если навык идеально подходит для задачи, модель может его проигнорировать.

Изображение из источника

Чтобы решить эту проблему, LangChain использует системные файлы (например, AGENTS.md или CLAUDE.md), которые всегда находятся в контексте. В них прописываются инструкции: «если видишь задачу типа X, используй навык Y». Это значительно повышает стабильность работы.

Также важен баланс. Слишком много мелких навыков путают агента (он выбирает не тот). Слишком крупные навыки перегружают контекст лишней информацией. Оптимум находится экспериментальным путем.

Финальный этап — A/B тестирование. Сравнивается работа агента без навыков («контрольная группа») и с разными конфигурациями навыков.

Результаты LangChain показательны: в одном из экспериментов агент с правильно настроенными навыками решал задачи в 82% случаев, тогда как без них — только в 9%. Это доказывает, что грамотная инженерия контекста и инструментов сегодня важнее, чем просто выбор самой мощной модели.

Мы переходим от этапа «промпт-инжиниринга» к этапу «инжиниринга агентных систем». Создание агента теперь напоминает классическую разработку ПО: нужны тесты, метрики, CI/CD пайплайны и контроль версий для промптов и инструментов. Успех агента зависит не от магии нейросети, а от дисциплины разработчика, создающего для этой нейросети рабочую среду.

Просто дать агенту доступ к инструментам недостаточно. Критически важно динамически подгружать только нужные навыки и строго тестировать их эффективность в изолированных средах.

Агенты часто «ленятся» или забывают использовать доступные навыки. Решение — жестко прописывать логику выбора инструментов в системных файлах (AGENTS.md), которые всегда в контексте.