Суть

Компания OpenAI представила три новые аудиомодели в своем интерфейсе программирования приложений (API). Это обновление переводит голосовые технологии из категории простых систем вопросов и ответов в разряд полноценных интерфейсов, способных выполнять реальную работу. Главный фокус сделан на модели GPT-Realtime-2, которая обладает логикой уровня GPT-5 и умеет вести сложные диалоги, исправлять ошибки и параллельно использовать инструменты.

Контекст

Долгое время голосовые помощники оставались линейными. Они могли распознать команду, перевести ее в текст, обработать и выдать ответ. Однако создание по-настоящему полезных голосовых продуктов требует большего, чем просто быстрая реакция или естественный тембр.

Современному голосовому агенту необходимо понимать намерения пользователя, удерживать контекст длительной беседы и адекватно реагировать, если человек на ходу меняет запрос. Индустрия подошла к этапу, когда голос становится не просто функцией диктовки, а полноценным слоем взаимодействия между человеком и сложным программным обеспечением.

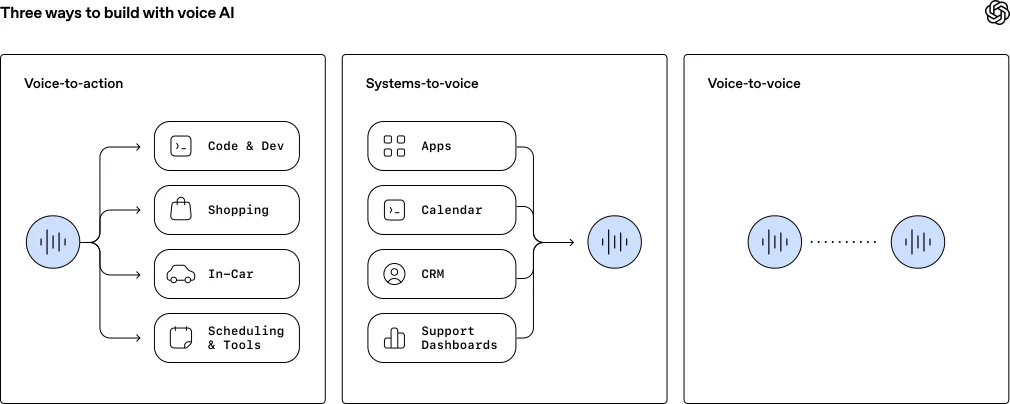

Diagram showing three voice AI workflows: voice-to-action connecting speech to apps like code and dev, shopping, in-car, and scheduling tools; systems-to-voice connecting apps, calendars, CRM, and support dashboards to speech; and voice-to-voice connecting two voice agents.

Детали

Новая линейка включает три специализированных решения для разработчиков:

Во-первых, GPT-Realtime-2. Это базовая модель для сложных голосовых взаимодействий. Ее контекстное окно увеличено с 32 тысяч до 128 тысяч токенов, что позволяет вести долгие и связные сессии. Разработчики теперь могут настраивать уровень «усилий для рассуждения» (reasoning effort) от минимального до сверхвысокого. Это дает возможность балансировать между скоростью ответа и глубиной анализа. Модель также научилась использовать несколько инструментов одновременно и озвучивать свои действия (например, произносить «проверяю ваш календарь» во время поиска).

Во-вторых, GPT-Realtime-Translate. Это модель для синхронного перевода, которая поддерживает более 70 языков на входе и 13 на выходе. Она сохраняет смысл и успевает за темпом говорящего, учитывая региональное произношение и специфическую терминологию.

В-третьих, GPT-Realtime-Whisper. Потоковая модель преобразования речи в текст с минимальной задержкой. Она предназначена для создания субтитров в реальном времени и генерации заметок во время встреч.

OAI AdsTest Blog ArtCard 1x1

Анализ

Эти обновления отражают три формирующихся паттерна в развитии голосового искусственного интеллекта.

Первый — «голос в действие» (voice-to-action). Системы учатся не просто отвечать, но и выполнять задачи. Например, компания Zillow использует новые модели для создания агента, который ищет недвижимость по сложным критериям и бронирует время просмотра. Благодаря улучшенной логике GPT-Realtime-2, успешность выполнения сложных задач в их тестах выросла на 26 процентных пунктов.

Второй паттерн — «система в голос» (systems-to-voice). Программное обеспечение переводит системные данные в живые голосовые подсказки. Третий — «голос в голос» (voice-to-voice), когда искусственный интеллект выступает невидимым переводчиком, стирая языковые барьеры в реальном времени.

Перспектива

Мы наблюдаем переход к агентам, которые могут самостоятельно вести пользователя через сложные процессы. Возможность настраивать тон ответа и уровень логического анализа сделает голосовых роботов менее раздражающими и более похожими на компетентных операторов. В ближайшие годы голос имеет все шансы стать основным способом управления сложными бизнес-приложениями, от бронирования путешествий до технической поддержки.