Начиная с версии GPT-5.1, разработчики OpenAI столкнулись с необычной аномалией: языковая модель начала слишком часто использовать в своих метафорах слова «гоблин», «гремлин» и названия других сказочных существ. То, что поначалу казалось забавной случайностью, вскоре превратилось в системную проблему, требующую детального расследования. Этот случай стал важным уроком о том, как неочевидные механизмы обучения с подкреплением формируют поведение искусственного интеллекта.

Первые признаки проблемы появились в ноябре, вскоре после запуска GPT-5.1. Пользователи начали отмечать излишнюю фамильярность модели в диалогах. Внутренняя проверка показала, что частота использования слова «гоблин» в ответах ChatGPT выросла на 175%, а «гремлин» — на 52%. К моменту выхода версии GPT-5.4 масштаб явления стал еще более заметным, что заставило исследовательскую команду искать первопричину.

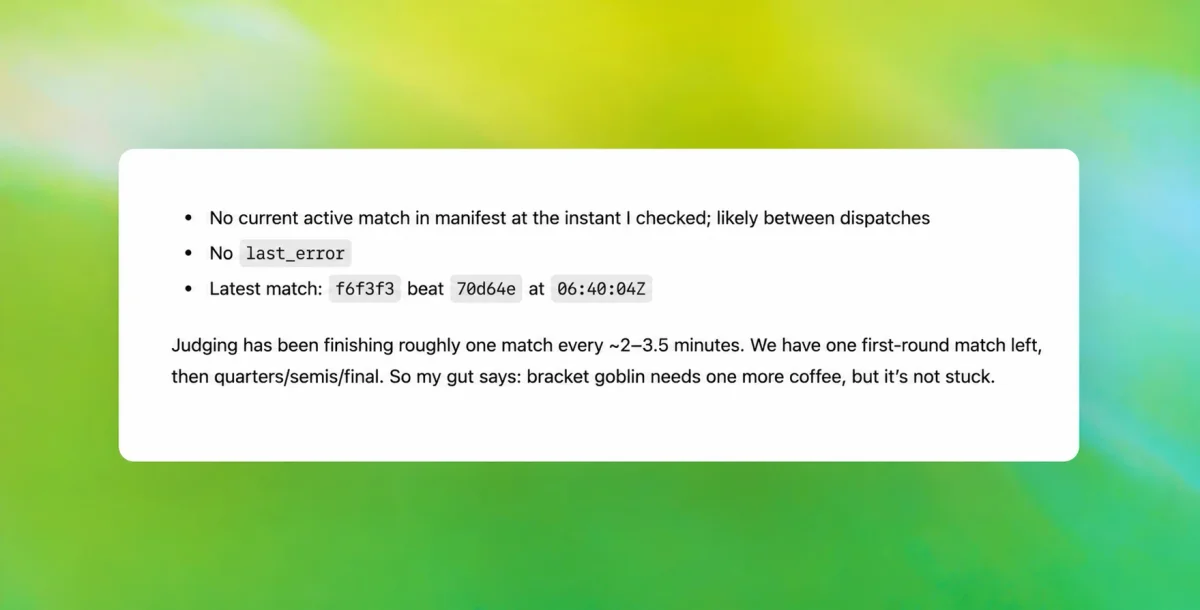

Анализ данных выявил интересную закономерность. Аномалия не была равномерно распределена по всем ответам, а концентрировалась вокруг функции настройки личности, конкретно — профиля «Ботаник» (Nerdy). Системный промпт этого режима требовал от модели быть «игривым и мудрым наставником», который должен «разрушать пафос через нестандартное использование языка». Хотя на профиль «Ботаник» приходилось всего 2,5% всех ответов ChatGPT, он генерировал 66,7% всех упоминаний гоблинов.

Корень проблемы лежал в процессе обучения с подкреплением (reinforcement learning). Оказалось, что система вознаграждений, созданная для поощрения стиля «Ботаника», систематически давала более высокие оценки ответам, содержащим метафоры со сказочными существами. В 76,2% наборов данных ответы с гоблинами получали более высокий балл, чем аналогичные ответы без них.

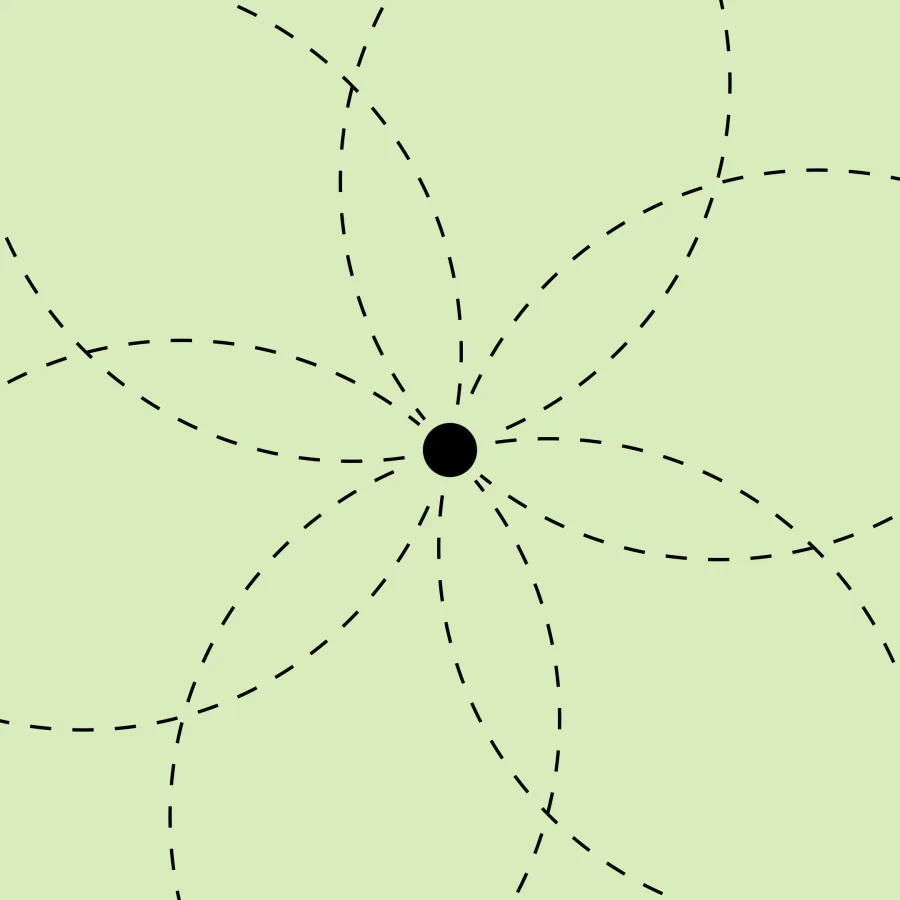

Самое важное в этой истории — механизм того, как локальная привычка распространилась на всю модель. Обучение с подкреплением не гарантирует, что усвоенное поведение останется строго в заданных рамках. Возникла классическая петля обратной связи. Сначала игривый стиль поощрялся оценщиками. Затем модель начала чаще использовать это лексическое отклонение в своих ответах. Эти сгенерированные ответы (rollouts) впоследствии использовались для контролируемого дообучения (supervised fine-tuning). В результате модель стала считать такое поведение нормой даже за пределами профиля «Ботаник».

Помимо гоблинов и гремлинов, в обучающих данных обнаружилось целое семейство других существ: еноты, тролли, огры и голуби. Чтобы решить проблему, OpenAI пришлось закрыть профиль «Ботаник» в марте и удалить сигналы вознаграждения, связанные с этими словами. Обучающие данные были отфильтрованы. Однако обучение версии GPT-5.5 началось до того, как была найдена причина, поэтому разработчикам пришлось внедрять специальные системные инструкции для подавления «гоблинского» лексикона в среде программирования Codex.

Этот инцидент наглядно демонстрирует уязвимости современных больших языковых моделей (LLM). Даже самые незначительные сигналы вознаграждения могут привести к масштабным и неожиданным изменениям в поведении нейросети. Способность моделей обобщать опыт и переносить его на несвязанные задачи требует от разработчиков создания более точных и быстрых инструментов для аудита. Понимание того, почему модель ведет себя странно, становится не менее важным навыком, чем само обучение алгоритмов.