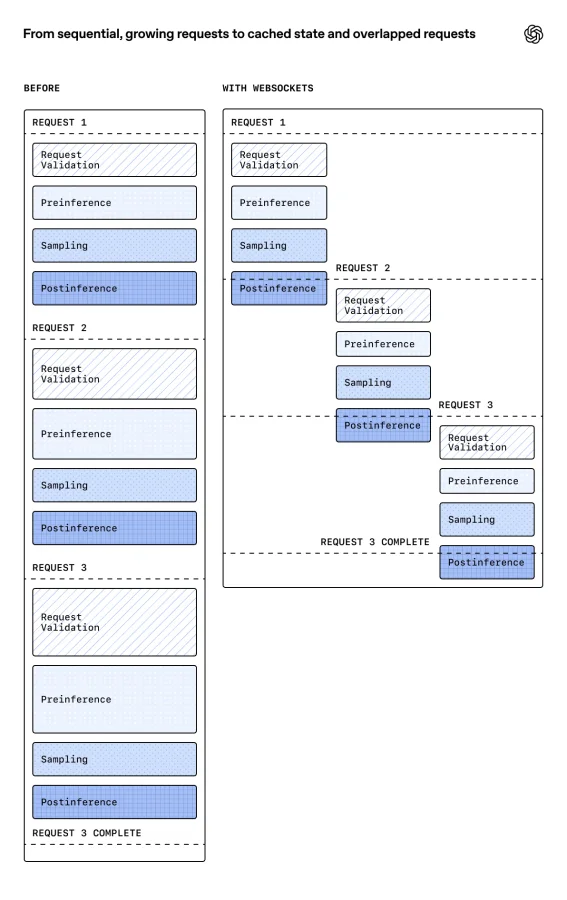

Ускорение агентных рабочих процессов: как переход на WebSockets снизил задержки API

Инженеры OpenAI внедрили поддержку WebSockets в Responses API, решив проблему сетевых задержек и ускорив работу автономных агентов на 40 процентов.

Суть

Компания OpenAI внедрила поддержку протокола WebSockets в свой Responses API, что позволило сократить задержки в агентных рабочих процессах на 40 процентов. Это обновление решает фундаментальную проблему: по мере того как генерация текста моделями становится быстрее, традиционная архитектура передачи данных начинает тормозить весь процесс.

Контекст

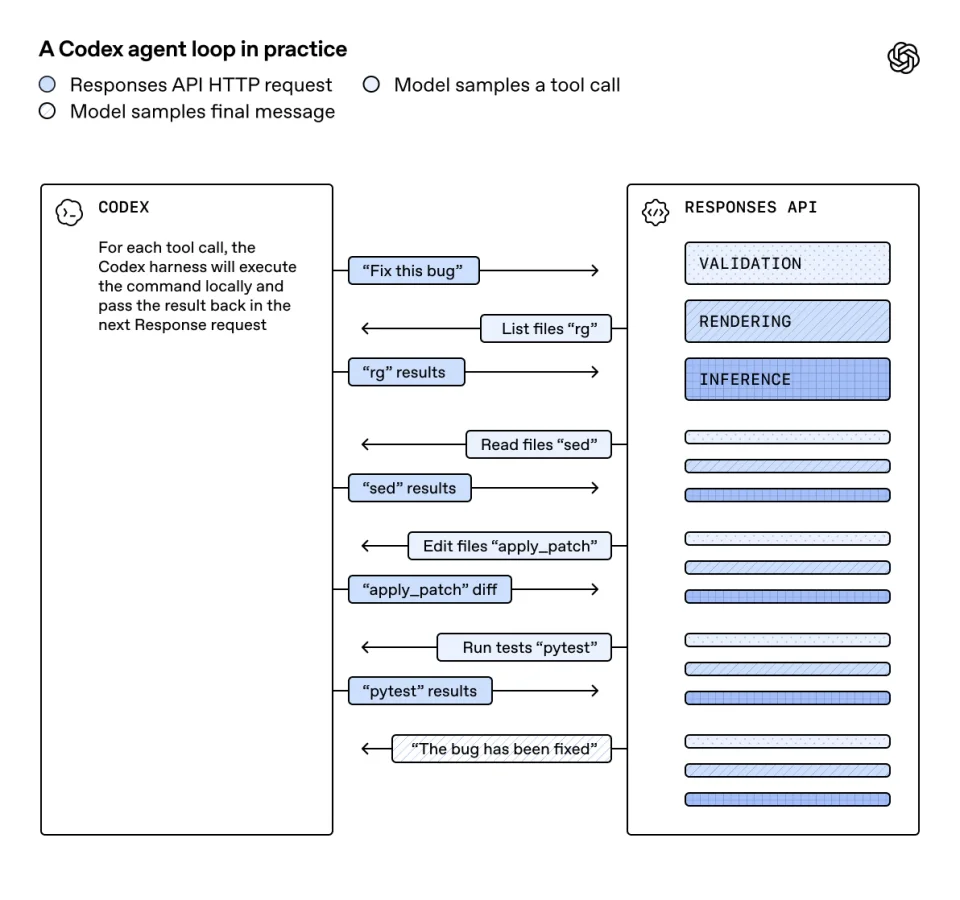

Когда автономный агент, например Codex, выполняет сложную задачу (анализирует код, вносит правки, запускает тесты), он совершает десятки последовательных обращений к API. Исторически самым медленным этапом этого цикла был вывод (inference) — процесс генерации новых токенов на графических процессорах (GPU).

Diagram titled “A Codex agent loop in practice” showing an iterative flow between Codex and the Responses API, with tool calls (rg, sed, apply_patch, pytest) and results exchanged until the final message: “The bug has been fixed.”

Однако с появлением новых специализированных аппаратных решений, таких как чипы Cerebras, скорость вывода многократно возросла. Для модели GPT-5.3-Codex-Spark целевой показатель составил более 1000 токенов в секунду. При таких скоростях узким местом стала сама инфраструктура API. В старой парадигме каждый запрос обрабатывался как независимый: системе приходилось заново передавать и обрабатывать всю историю диалога, что создавало огромные накладные расходы.

Детали

Чтобы устранить эти ограничения, разработчики пересмотрели транспортный протокол и перешли на использование постоянного соединения через WebSockets.