Анализ отчета Anthropic: почему пользователи заметили ухудшение работы Claude Code

Разбор трех технических ошибок, которые привели к временному снижению качества ответов Claude Code, и выводы компании для предотвращения подобных ситуаций.

Разбор трех технических ошибок, которые привели к временному снижению качества ответов Claude Code, и выводы компании для предотвращения подобных ситуаций.

3 мин

Суть

Компания Anthropic опубликовала детальный отчет об ошибках (postmortem) в ответ на жалобы пользователей об ухудшении работы инструмента Claude Code. Расследование показало, что проблема заключалась не в деградации базовых моделей, а в трех независимых изменениях на уровне продукта и интерфейса. Все проблемы были устранены, а этот случай стал важным уроком по управлению качеством ИИ-систем.

Контекст

Создание продуктов на базе больших языковых моделей (LLM) — это постоянный поиск компромисса между качеством ответов, скоростью работы и стоимостью вычислений. В случае с Claude Code инженеры пытались оптимизировать пользовательский опыт: уменьшить задержки и снизить расход лимитов. Однако эти благие намерения, наложившись друг на друга в короткий промежуток времени, создали у пользователей ощущение глобальной деградации интеллекта модели.

Детали

Изображение из источника

В ходе расследования инженеры выявили три отдельные проблемы, повлиявшие на разные группы пользователей.

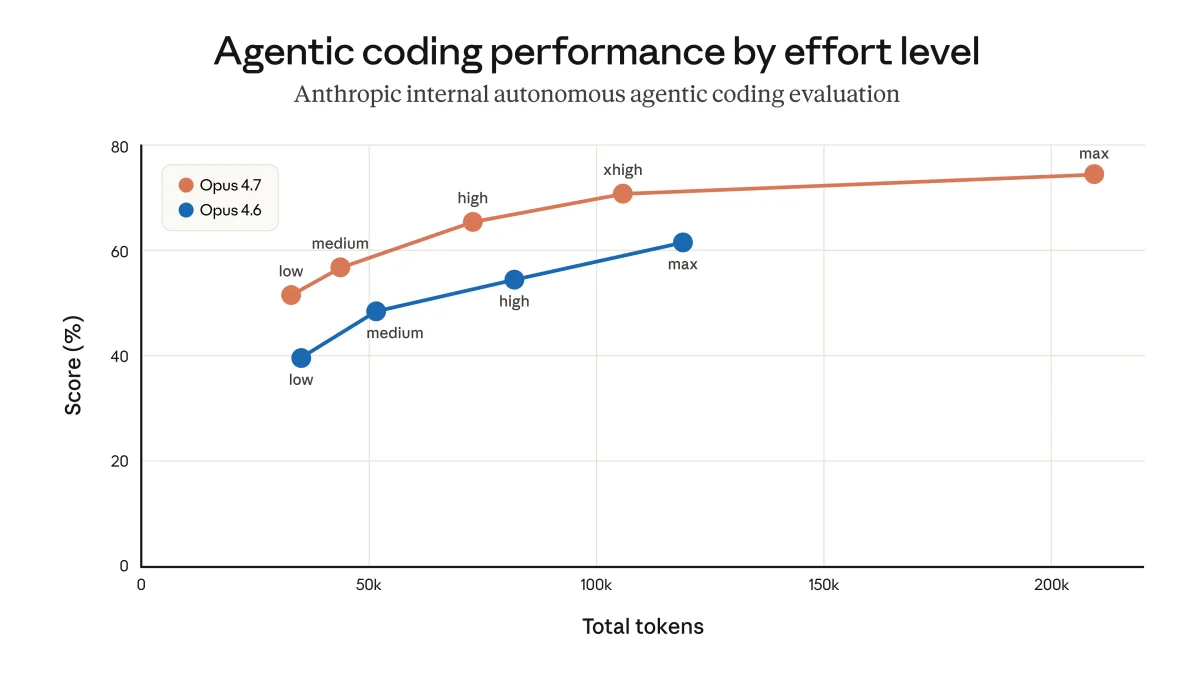

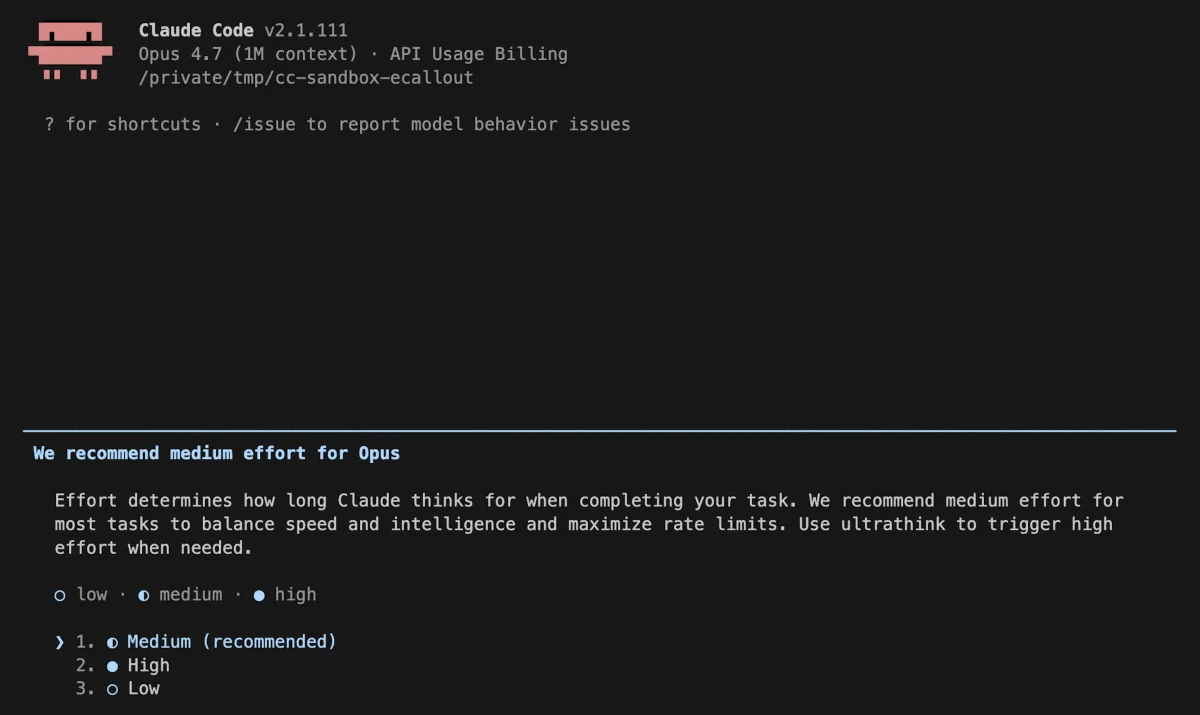

Во-первых, изменение уровня усилий для размышлений (reasoning effort). В начале марта разработчики сделали средний уровень размышлений настройкой по умолчанию, чтобы интерфейс не казался «зависшим» при сложных запросах. Оказалось, что пользователи предпочитают ждать дольше, но получать максимально качественный результат. Изменение было отменено.

Во-вторых, ошибка в оптимизации кэширования. Чтобы ускорить возобновление старых сессий, разработчики внедрили функцию очистки старых «размышлений» модели после часа неактивности. Из-за программной ошибки эта очистка начала срабатывать на каждом шаге диалога. Модель постоянно теряла контекст своих предыдущих действий, что выглядело как забывчивость и повторения.

В-третьих, неудачное изменение системного промпта (system prompt). Для борьбы с излишней многословностью новой модели Opus 4.7 было добавлено жесткое ограничение: не более 25 слов между вызовами инструментов. Это ограничение неожиданно снизило качество написания кода на 3%, что было выявлено только при расширенном тестировании.

Анализ

Изображение из источника

Этот инцидент наглядно демонстрирует хрупкость современных ИИ-продуктов. Изменения, которые успешно проходят базовые автоматические тесты и внутренние проверки, могут давать непредсказуемый результат в реальных условиях.

Особенно показателен случай с системным промптом. Жесткие ограничения на формат или длину вывода часто вступают в конфликт со способностью модели к глубокому анализу. Попытка сделать ответы более лаконичными напрямую ударила по качеству программирования.

Также стоит отметить сложность отладки систем, где пересекаются управление контекстом, API и скрытые цепочки размышлений. Баг с кэшированием не был обнаружен сразу из-за параллельных внутренних экспериментов, которые маскировали проблему.

Перспектива

Anthropic делает правильные выводы из ситуации, внедряя более строгое тестирование системных промптов (включая метод абляции — поочередное удаление строк для оценки их влияния).

Интересно, что для поиска причины бага компания использовала собственную модель Opus 4.7, которая смогла найти ошибку в коде, когда ей предоставили полный контекст репозиториев. Это указывает на будущее, где ИИ-модели будут играть ключевую роль в отладке систем, построенных на их же основе. Публичный и детальный разбор таких ошибок укрепляет доверие к разработчикам и задает высокий стандарт прозрачности для всей индустрии.

Ухудшение работы Claude Code было вызвано не деградацией базовых моделей, а тремя неудачными обновлениями продукта, включая программные баги и жесткие ограничения в системном промпте.

Даже незначительные изменения в системном промпте для контроля многословности могут непропорционально сильно ударить по аналитическим способностям модели.