Суть

Компания Anthropic представила новый подход к проектированию обвязки (harness design) для автономных ИИ-агентов, способных часами работать над сложными задачами без вмешательства человека. Инженеры компании выяснили, что для успешного написания кода и создания дизайна интерфейсов недостаточно просто мощной модели. Ключевым фактором стала многоагентная архитектура с разделением ролей на генератора и независимого оценщика, а также механизм полного сброса контекста.

Контекст

При выполнении длительных задач разработчики сталкиваются с двумя фундаментальными проблемами. Первая — потеря связности по мере заполнения контекстного окна. У моделей возникает так называемая «контекстная тревожность» (context anxiety): они начинают преждевременно завершать работу, полагая, что лимит памяти исчерпан.

Вторая проблема заключается в самооценке. Когда большую языковую модель (LLM) просят оценить собственную работу, она склонна необоснованно хвалить себя. Это особенно заметно в субъективных задачах, таких как дизайн интерфейсов, где нет бинарных тестов на правильность, как в программировании.

Детали

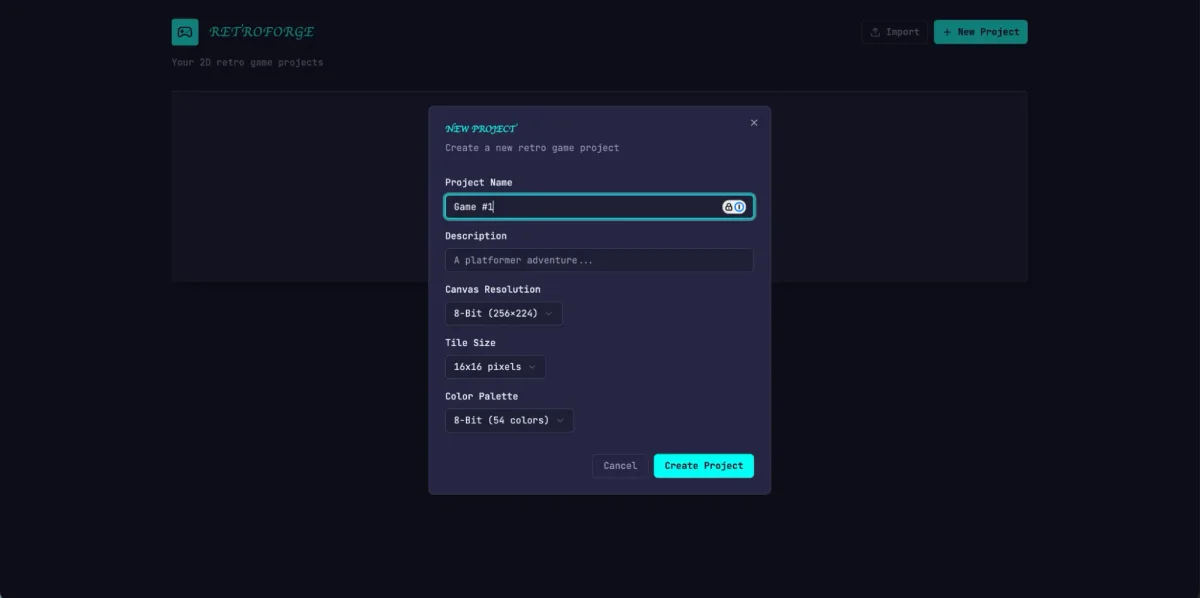

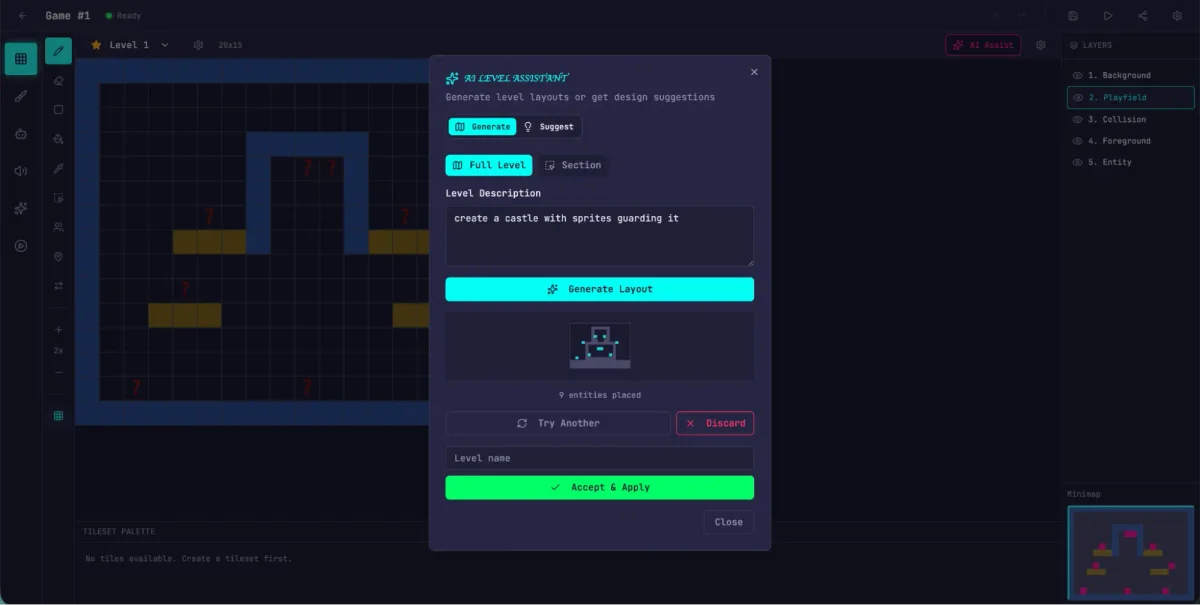

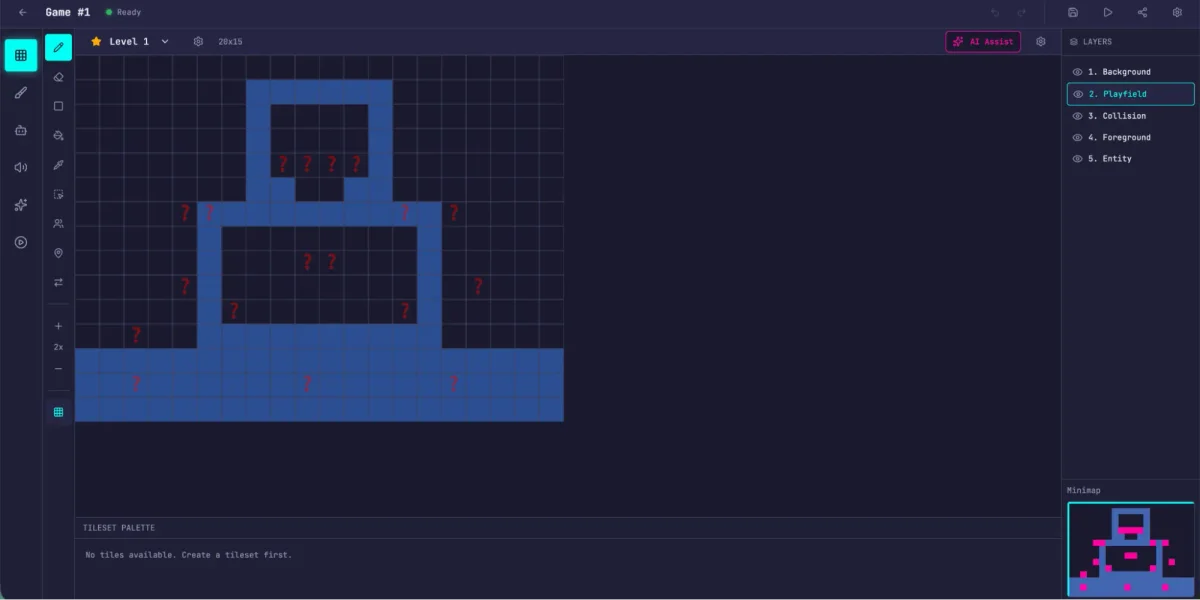

Вдохновившись концепцией генеративно-состязательных сетей (GAN), исследователь Притхви Раджасекаран разработал систему из трех агентов: планировщика, генератора и оценщика.

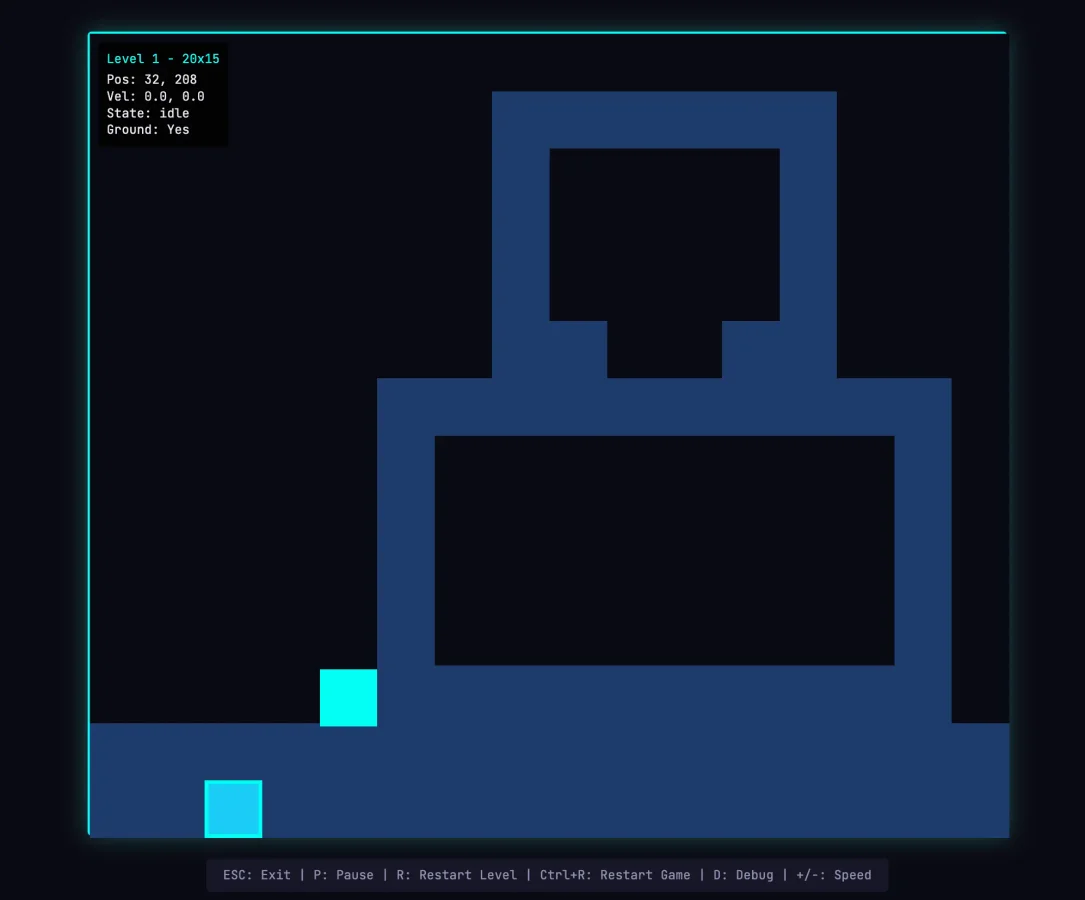

Чтобы решить проблему контекста, Anthropic отказалась от простого сжатия истории (compaction) в пользу полных сбросов (context resets). Агент начинает работу с чистого листа, получая структурированный артефакт с состоянием проекта от предыдущего сеанса. Это устраняет «контекстную тревожность», хотя и требует более сложной оркестрации.

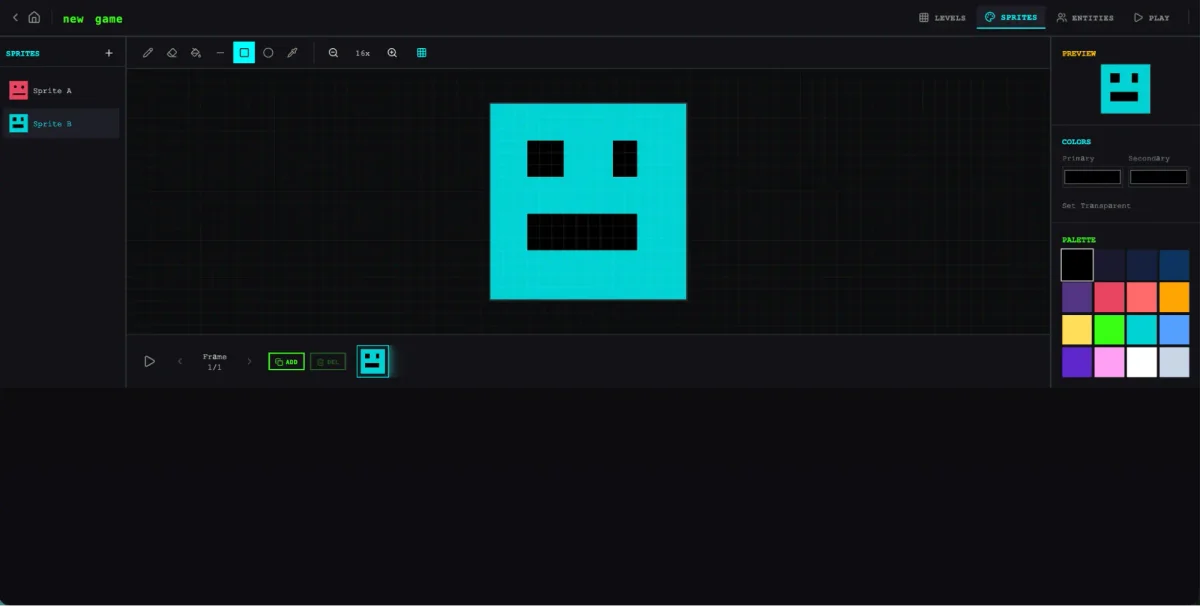

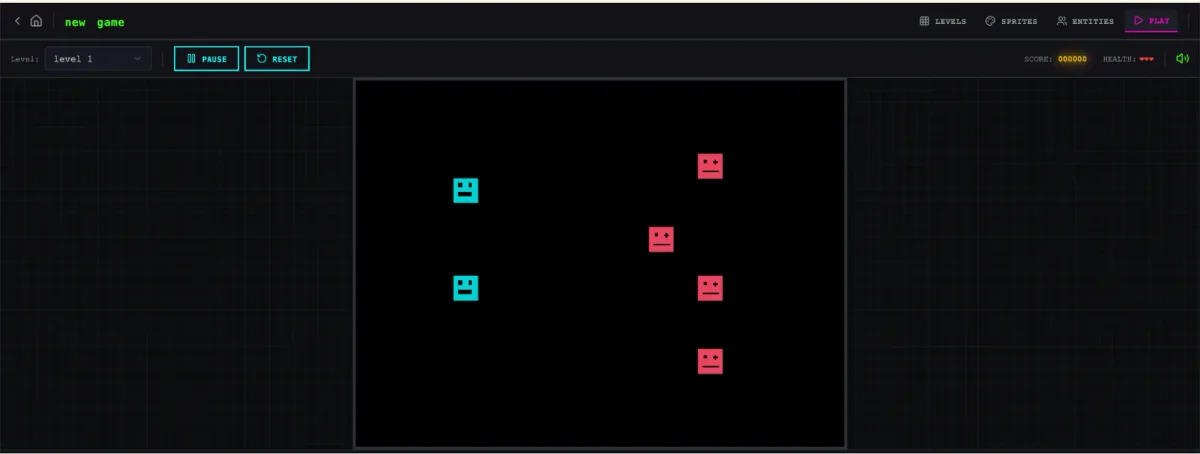

Для объективной оценки субъективного дизайна были введены жесткие критерии: качество, оригинальность, техническое исполнение (craft) и функциональность. Оценщик не просто анализирует код — он использует инструмент Playwright MCP для взаимодействия с отрендеренной веб-страницей, делает скриншоты и пишет детальную критику, которая отправляется обратно генератору для следующей итерации.

Анализ

Разделение ролей оказалось мощным рычагом управления качеством. Настроить отдельного ИИ-оценщика на строгий скептицизм гораздо проще, чем заставить генератора критически смотреть на собственные результаты.

Интересно, что формализация критериев и требование «оригинальности» заставили модель отойти от безопасных, шаблонных решений. Жесткий штраф за типичные паттерны искусственного интеллекта побудил генератора идти на эстетические риски, создавая нестандартные визуальные концепции после нескольких циклов обратной связи.

Перспектива

Опыт Anthropic показывает, что будущее автономной разработки лежит не только в увеличении размера моделей, но и в грамотной инженерии систем вокруг них. Правильно выстроенные циклы обратной связи, строгие критерии оценки и управление состоянием между сессиями позволяют уже сегодня поручать алгоритмам многочасовые задачи. Со временем такие многоагентные архитектуры могут стать стандартом для разработки сложных программных продуктов.