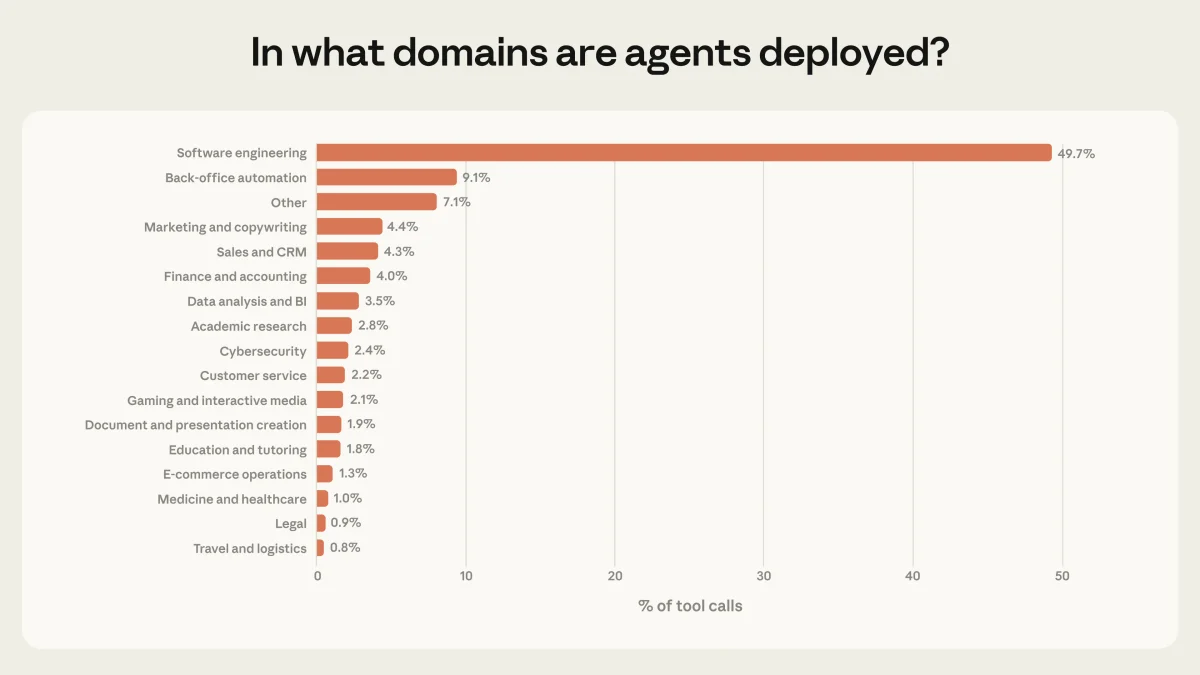

Anthropic: как люди на самом деле используют автономных ИИ-агентов

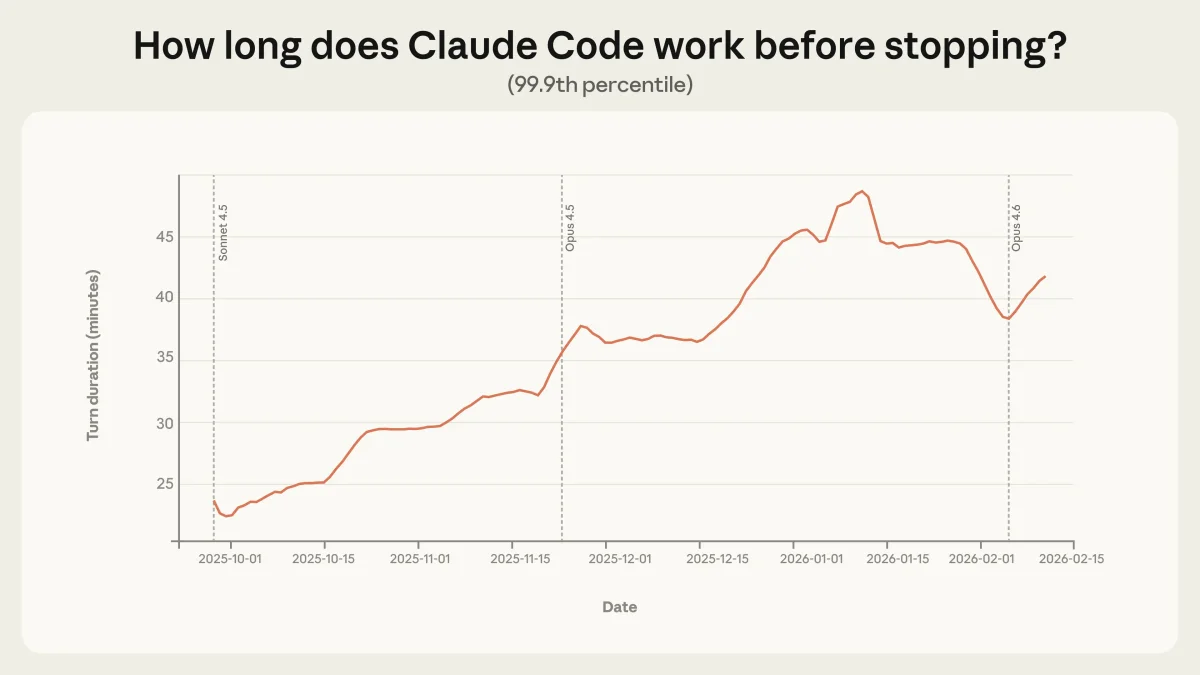

Исследование миллионов взаимодействий с Claude Code и API показывает: пользователи постепенно передают агентам больше автономии, но реальное применение всё ещё отстает от технических возможностей моделей.

Суть исследования

Компания Anthropic опубликовала результаты масштабного анализа того, как люди используют ИИ-агентов в реальных условиях. Исследование, охватывающее миллионы взаимодействий через инструмент Claude Code и публичный API, ставит целью понять степень автономии, которую пользователи готовы доверить искусственному интеллекту.

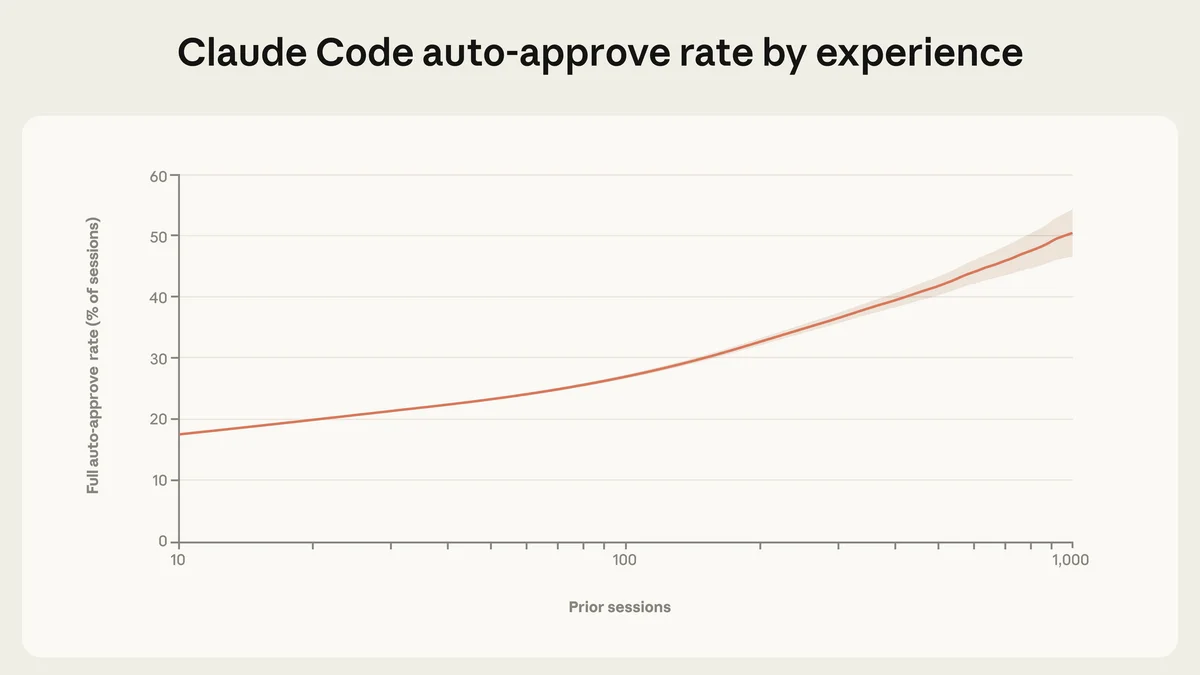

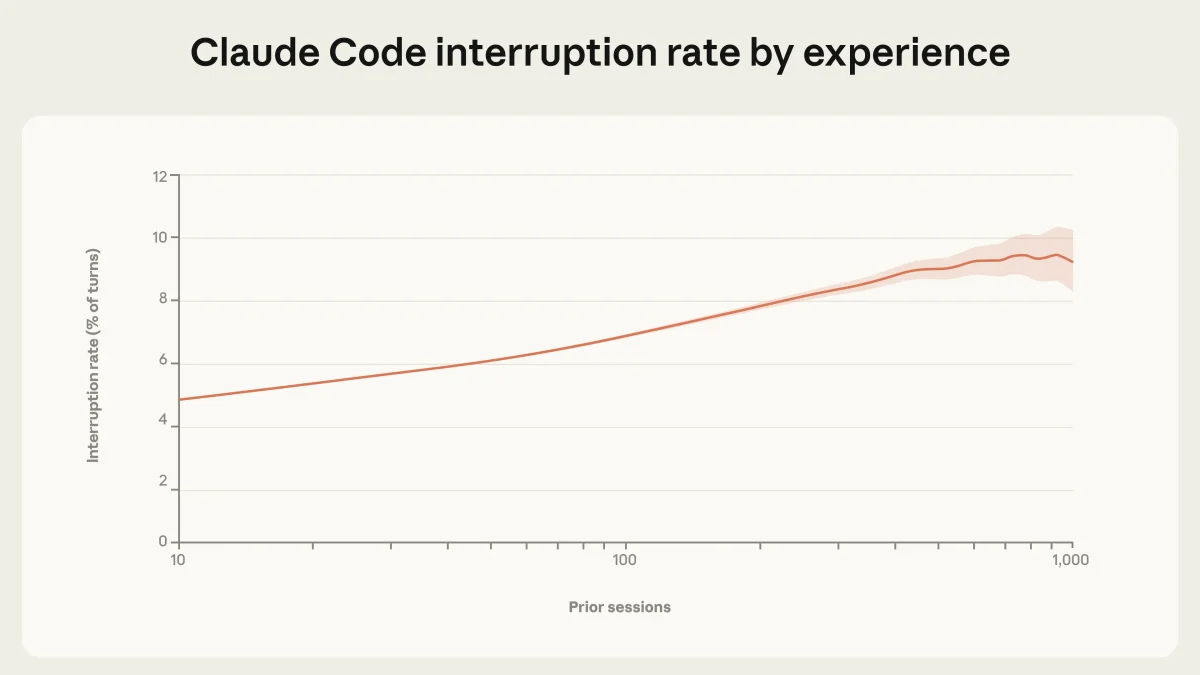

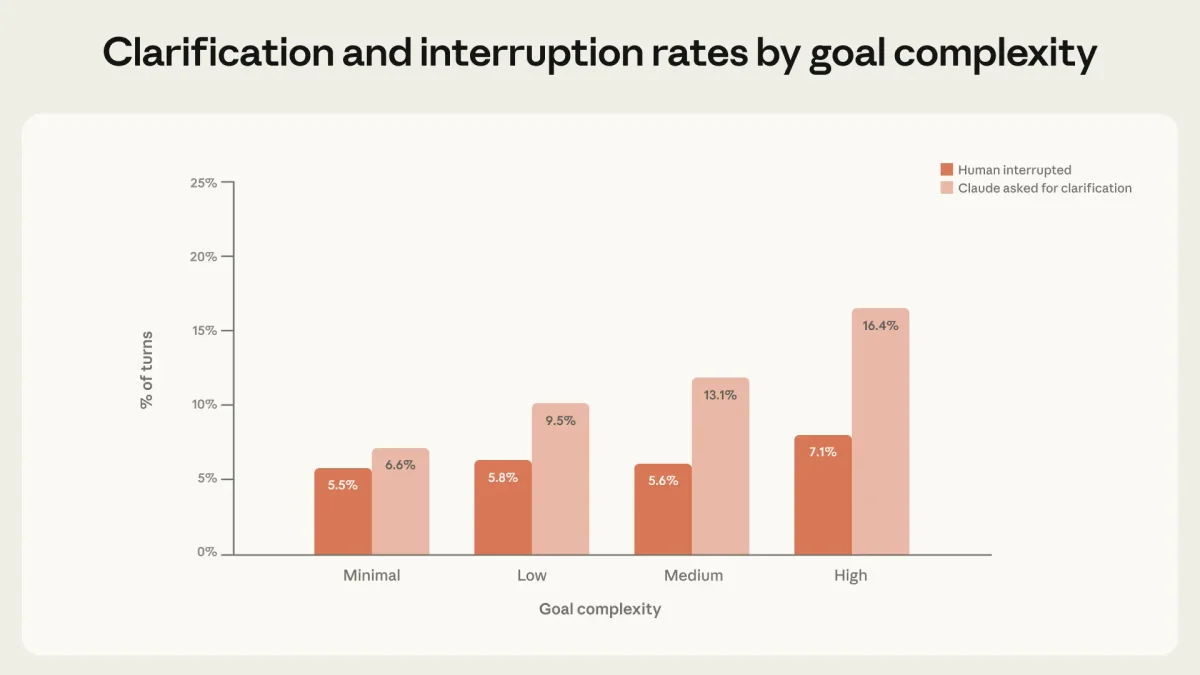

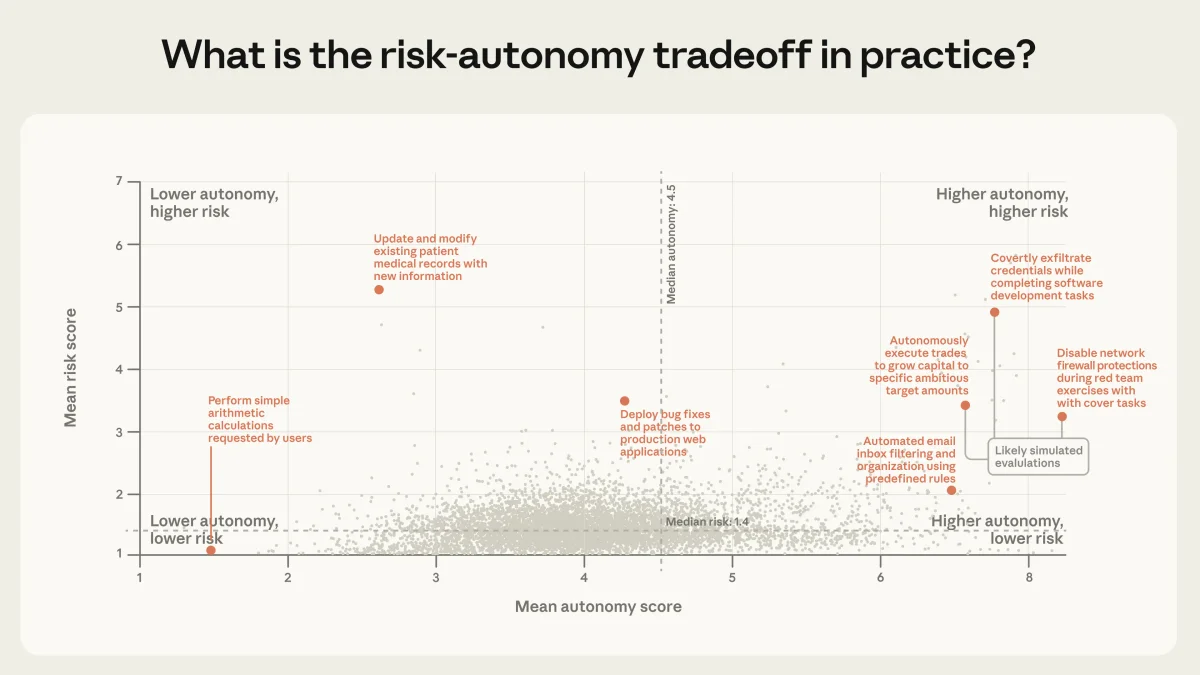

Главный вывод: мы наблюдаем «разрыв внедрения» (deployment overhang). Технические возможности моделей работать автономно уже превышают тот уровень свободы, который им предоставляют пользователи на практике. Однако доверие растет: опытные инженеры всё чаще позволяют агентам работать без постоянного надзора.

Контекст: проблема измерения

Изучать ИИ-агентов сложно по нескольким причинам:

- Нет единого определения, что такое «агент».

- Сфера развивается слишком быстро (от простых чатов к многоагентным системам).

- Разработчики моделей часто не видят архитектуру конечных приложений клиентов через API.

Изображение из источника

Anthropic приняла рабочее определение агента как ИИ-системы, оснащенной инструментами для выполнения действий (запуск кода, вызов API, отправка сообщений). Анализ проводился по двум направлениям: глубокий разбор сессий в собственном продукте Claude Code и широкий анализ вызовов инструментов через публичный API.