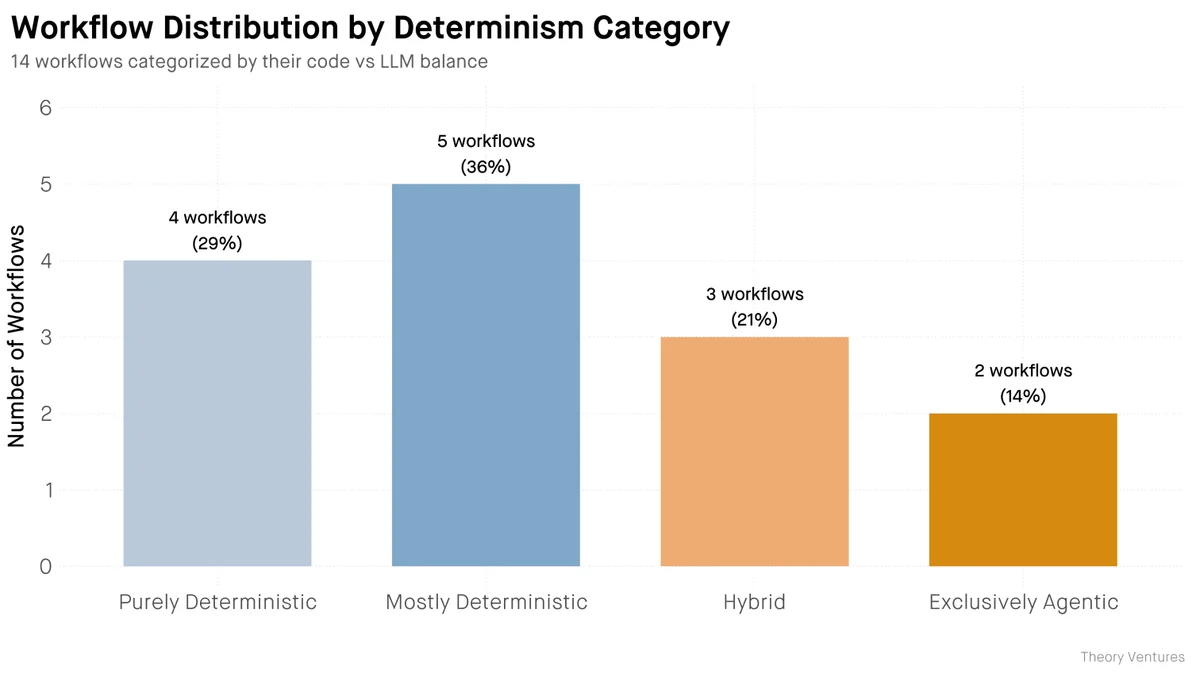

Эволюция AI-агентов: почему 65% работы снова выполняет обычный код

Анализ 14 рабочих процессов показывает, что полностью автономные агенты уступают гибридным системам. Разбираем, почему разработчики ограничивают свободу LLM и возвращаются к детерминированному коду.

Суть

В индустрии разработки искусственного интеллекта наметился важный тренд: отказ от идеи «всемогущего агента» в пользу гибридных архитектур. Анализ реальных внедрений показывает, что наиболее эффективные системы передают большим языковым моделям (LLM) лишь часть задач, оставляя до 90% работы старому доброму программному коду. Это не шаг назад, а признак взросления технологии: мы начинаем понимать, где нейросети действительно незаменимы, а где они лишь усложняют процесс и снижают надежность.

Контекст

Еще полгода назад подход к созданию AI-агентов был максималистским. Разработчики стремились создать системы, где модель получала бы задачу (например, «исследуй этот рынок») и самостоятельно выполняла все шаги: от поиска инструментов до структурирования данных. Это называлось «полностью агентным» подходом.

Однако практика показала слабости такой архитектуры. Модели, получив полную свободу, часто «галлюцинировали», выбирали неверные инструменты или застревали в бесконечных циклах попыток. Попытки ограничить их с помощью промптов (инструкций) или специальных инструментов помогали лишь отчасти. Надежность таких систем в продакшене оставалась низкой, а стоимость — высокой из-за огромного количества токенов, расходуемых на размышления модели.

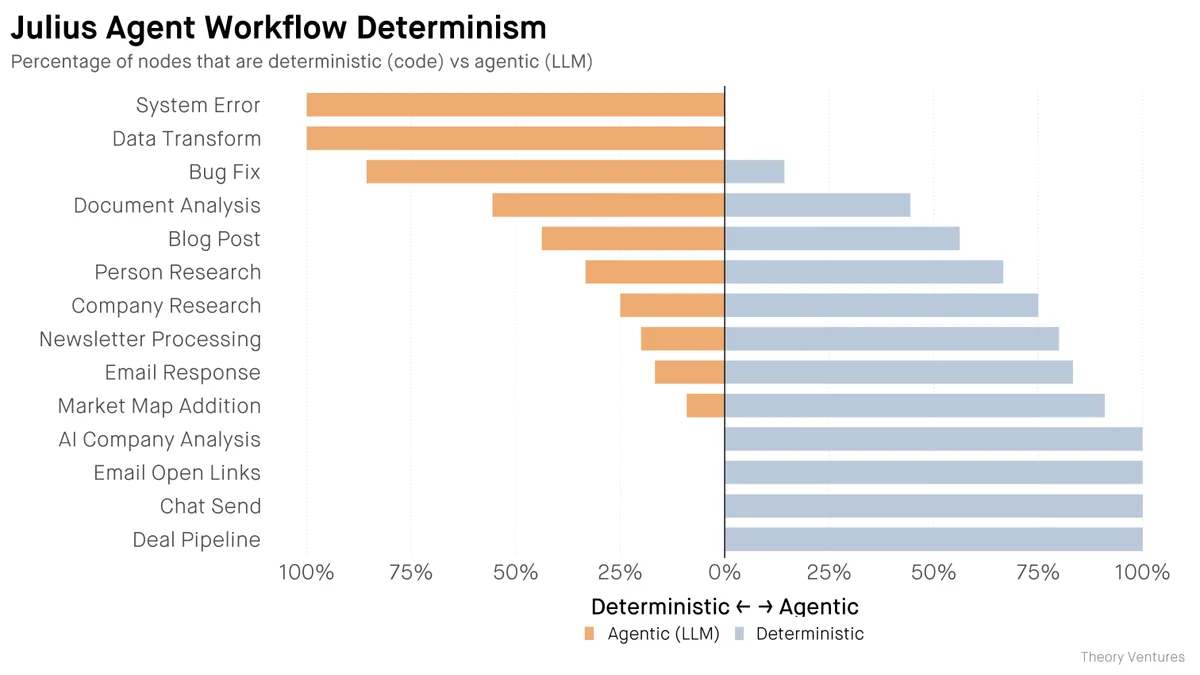

Julius Workflow Determinism

Детали

Том Тунгуз, известный венчурный инвестор и аналитик, провел исследование 14 рабочих процессов AI-агентов. Результаты оказались показательными. В оптимизированных системах около 65% узлов рабочего процесса выполняются как чистый, детерминированный код, без участия нейросетей.