Суть события

Google объявила о запуске новой модели искусственного интеллекта — Gemini 3.1 Flash-Lite. Это решение позиционируется как самый быстрый и экономически эффективный инструмент в третьем поколении моделей Gemini. Главная цель выпуска — предоставить разработчикам и бизнесу доступ к качественному интеллекту для задач огромного масштаба, где критичны не столько глубина философских рассуждений, сколько скорость реакции и стоимость обработки данных.

Модель уже доступна в предварительном просмотре (preview) через Gemini API в Google AI Studio и для корпоративных клиентов через Vertex AI. По сути, Google продолжает агрессивную ценовую войну, предлагая инструменты, которые делают внедрение ИИ в повседневные бизнес-процессы рентабельным.

Технические детали и цифры

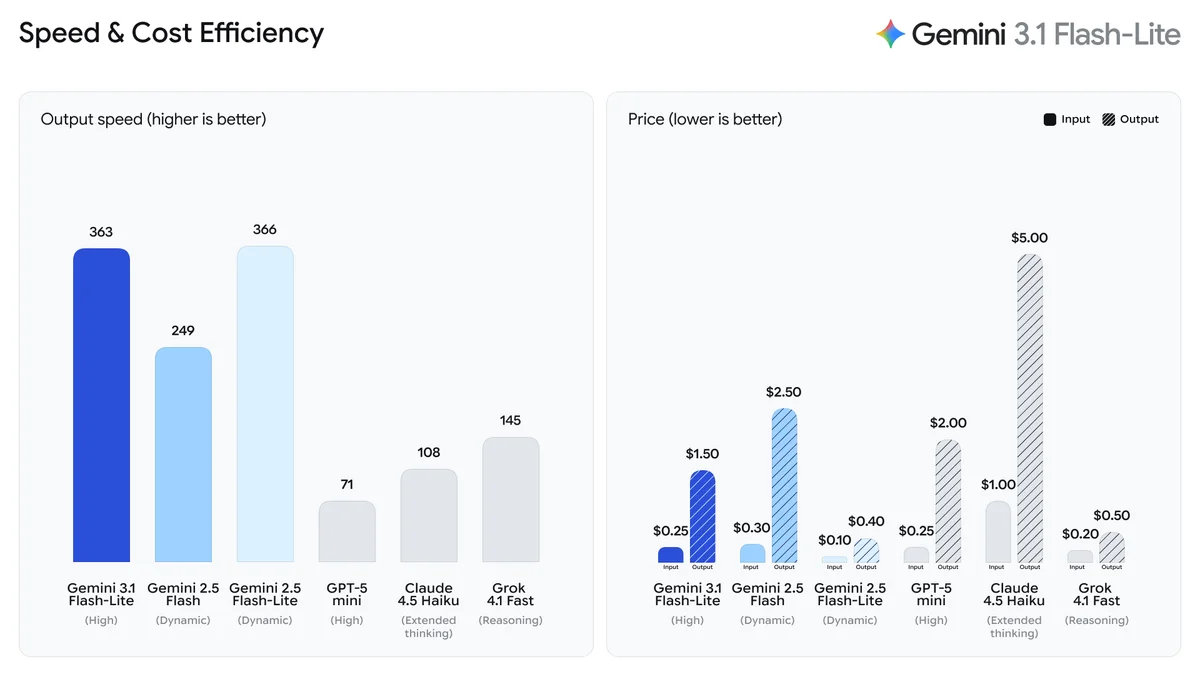

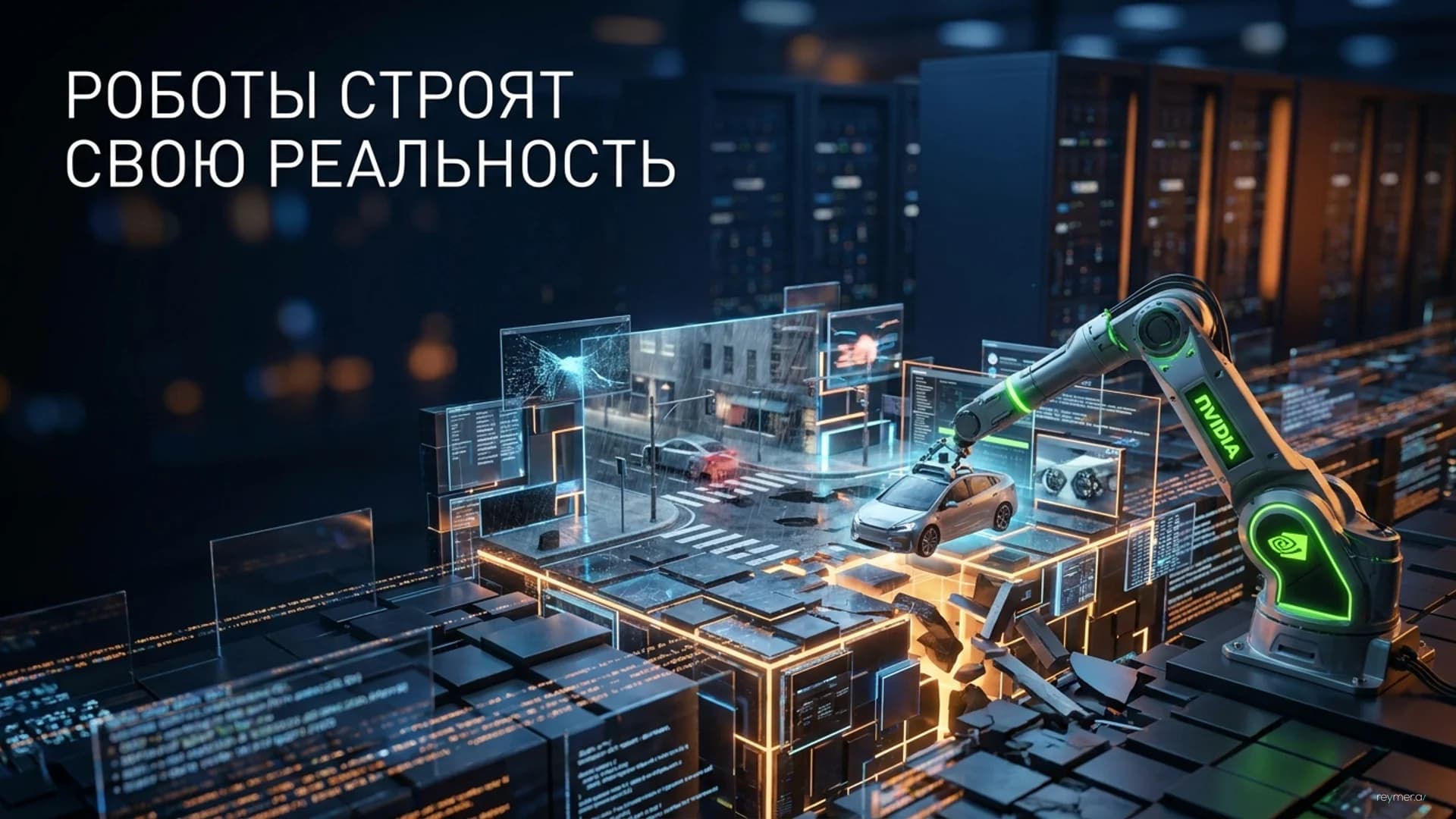

Самое важное в этом анонсе — это комбинация цены и производительности. Google заявляет следующие характеристики:

The image shows two bar charts titled "Speed & Cost Efficiency," comparing the "Output speed (higher is better)" and "Price (lower is better)" of Gemini 3.1 Flash-Lite against several other models, including Gemini 2.5 Flash-Lite, GPT-5 mini, Claude 4.5 Haiku, and Grok 4.1 Fast.

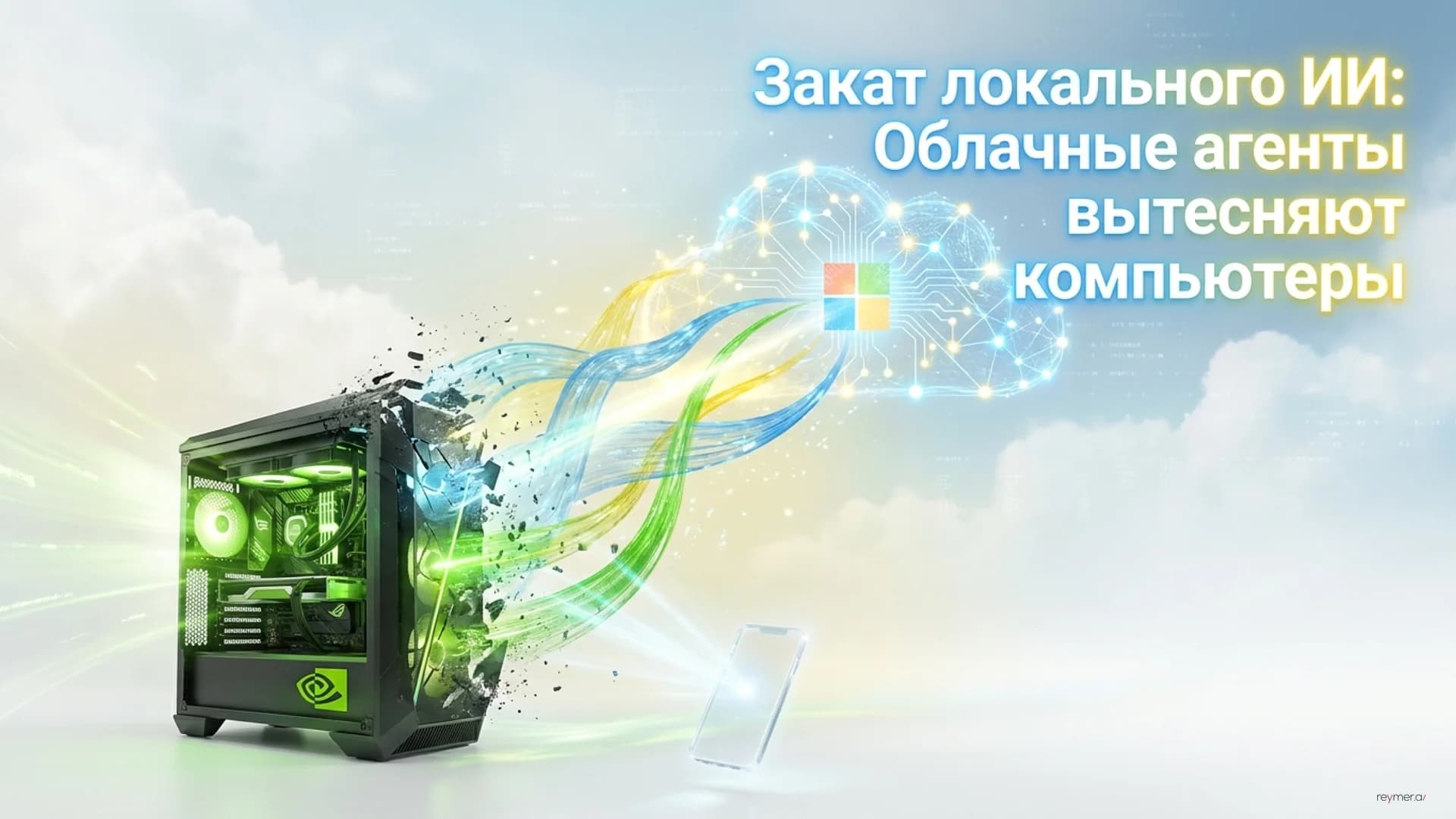

- Стоимость: $0.25 за 1 миллион входных токенов и $1.50 за 1 миллион выходных токенов. Это крайне низкий порог входа, позволяющий обрабатывать огромные массивы текста без разорения бюджета.

- Скорость: По сравнению с предыдущей моделью (Gemini 2.5 Flash), новинка демонстрирует ускорение в 2.5 раза по показателю «время до первого токена» (Time to First Answer Token). Скорость генерации ответа выросла на 45%.

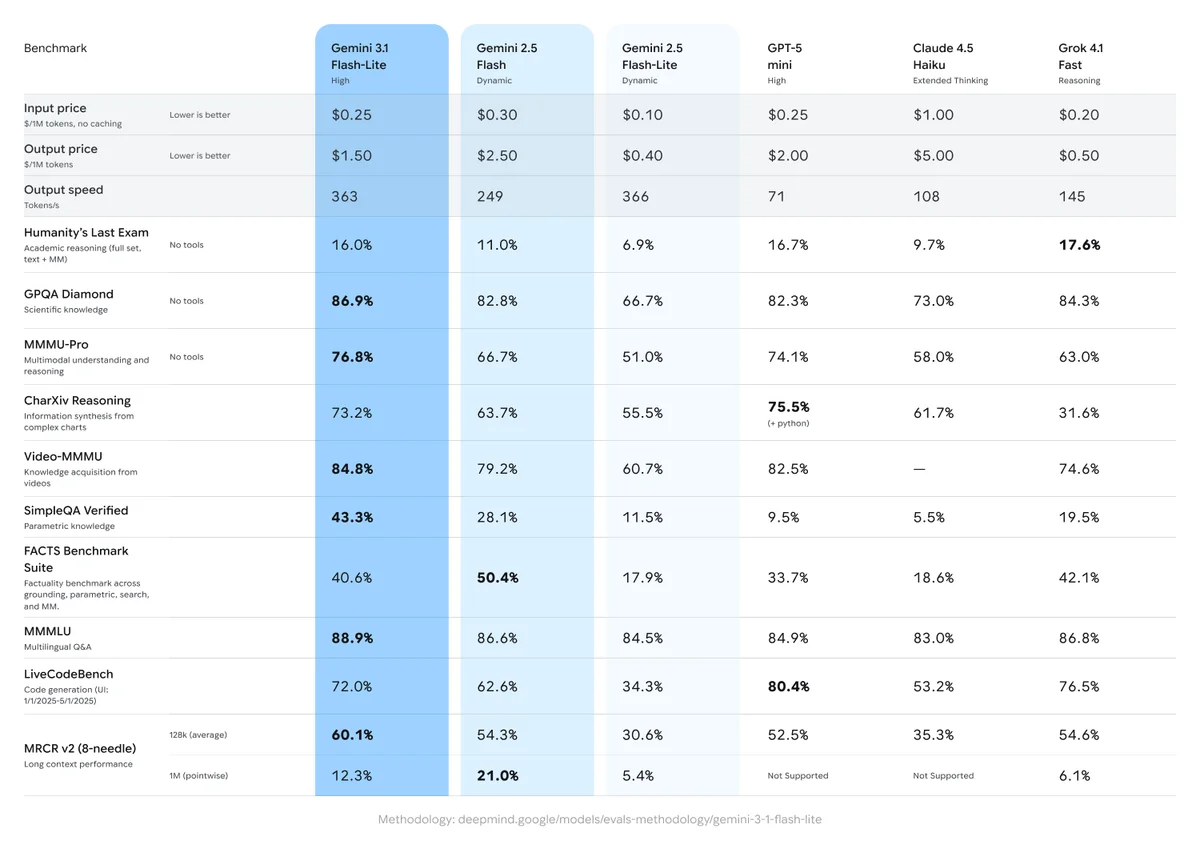

- Качество: Несмотря на приставку «Lite», модель показывает высокие результаты в бенчмарках. На Arena.ai Leaderboard она получила рейтинг Elo 1432. В тестах на рассуждение (GPQA Diamond) результат составил 86.9%, а в мультимодальных задачах (MMMU Pro) — 76.8%.

Интересно, что модель поддерживает функцию «уровней мышления» (thinking levels). Это позволяет разработчикам регулировать, сколько вычислительных ресурсов модель должна потратить на «обдумывание» ответа перед генерацией. Для простых задач этот параметр можно снизить ради скорости, для сложных — повысить ради точности.

Контекст: Гонка за эффективность

Индустрия ИИ переходит от фазы «посмотрите, как умно» к фазе «посмотрите, как быстро и дёшево». Первые поколения больших языковых моделей (LLM) были громоздкими и дорогими в эксплуатации. Сейчас же мы наблюдаем тренд на специализацию.

Модели класса Flash (у Google) или mini/turbo (у конкурентов вроде OpenAI) предназначены не для написания романов, а для утилитарных задач: модерации контента, перевода в реальном времени, извлечения данных из документов или управления интерфейсами. Gemini 3.1 Flash-Lite — это прямой ответ на потребность рынка в «рабочих лошадках», которые могут обрабатывать миллионы запросов в минуту с минимальной задержкой.

Анализ: Что это меняет для бизнеса

The image displays a comparison table of several AI models, including "Gemini 3.1 Flash-Lite," "Gemini 2.5 Dynamic," "Gemini 2.5 Flash-Lite," "GPT-5 mini," "Claude 4.5 Haiku," and "Grok 4.1 Fast," across various metrics such as input/output price, output speed, and different academic, reasoning, and factual benchmarks.

Снижение стоимости токена до $0.25 за миллион открывает двери для сценариев, которые раньше считались экономически нецелесообразными. Например:

- Тотальная модерация: Компании могут автоматически проверять каждое сообщение или комментарий на платформе без существенных затрат.

- Динамические интерфейсы: Модель способна генерировать элементы пользовательского интерфейса (UI) на лету, подстраиваясь под конкретного пользователя.

- Обработка данных в реальном времени: Благодаря низкой задержке (low latency), модель можно встраивать в голосовые помощники или системы мгновенного перевода, где ожидание ответа более секунды раздражает пользователя.

Google утверждает, что модель превосходит Gemini 2.5 Flash не только в скорости, но и в качестве, что указывает на оптимизацию архитектуры, а не просто на урезание параметров сети.

Перспектива

Выпуск Gemini 3.1 Flash-Lite усиливает конкуренцию в сегменте «лёгких» моделей. Это заставит других игроков (OpenAI, Anthropic, Mistral) пересматривать свои тарифные сетки и оптимизировать свои модели для снижения задержки.

В долгосрочной перспективе мы увидим ещё большее расслоение: гигантские модели для научных открытий и сложного планирования будут сосуществовать с тысячами сверхбыстрых специализированных моделей, работающих незаметно для пользователя внутри каждого приложения. Google сейчас активно занимает именно эту нишу массовой инфраструктуры.