NVIDIA передает управление драйвером распределения ресурсов GPU сообществу Kubernetes

Переход драйвера DRA под управление фонда CNCF стандартизирует управление ИИ-нагрузками и упрощает масштабирование высокопроизводительных кластеров.

Переход драйвера DRA под управление фонда CNCF стандартизирует управление ИИ-нагрузками и упрощает масштабирование высокопроизводительных кластеров.

3 мин

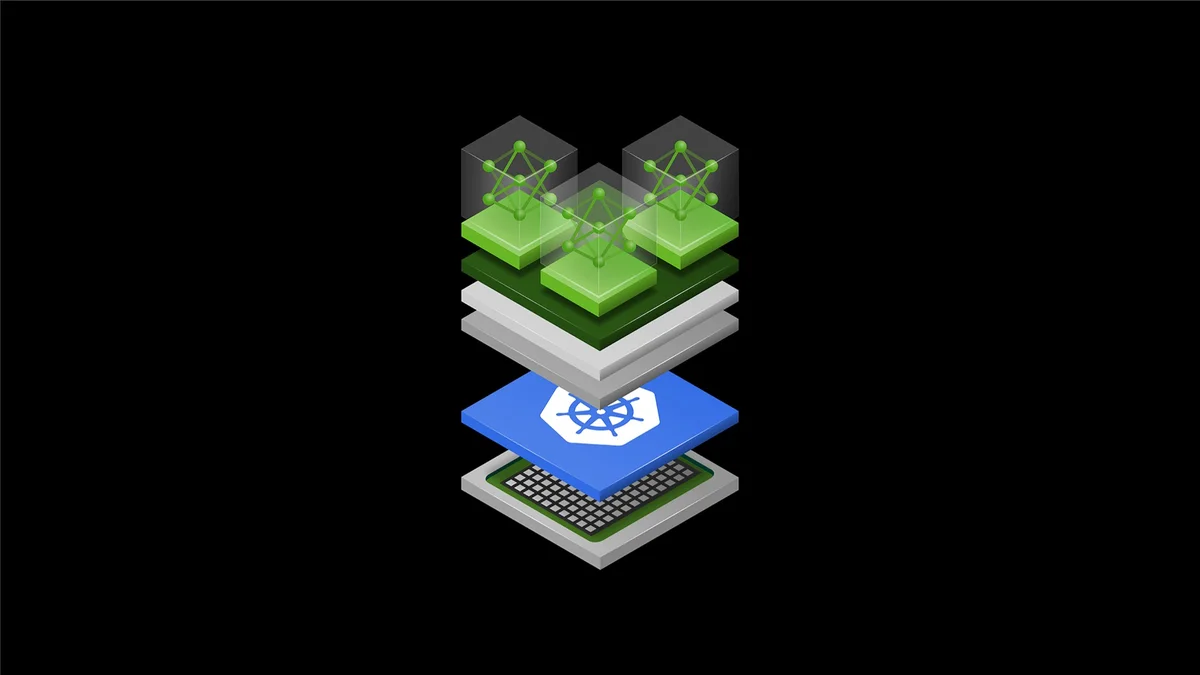

Компания NVIDIA объявила о передаче драйвера динамического распределения ресурсов графических процессоров (Dynamic Resource Allocation, DRA) в ведение фонда Cloud Native Computing Foundation (CNCF). Это означает переход критически важного компонента ИИ-инфраструктуры от закрытой корпоративной разработки к открытому управлению сообществом. Данный шаг призван упростить развертывание, масштабирование и управление высокопроизводительными вычислениями в средах Kubernetes.

Исторически управление мощными графическими процессорами (GPU) в центрах обработки данных было сложной задачей. Kubernetes стал стандартом де-факто для автоматизации развертывания контейнерных приложений. Однако интеграция специфических аппаратных ускорителей требовала использования проприетарных плагинов и надстроек.

По мере того как искусственный интеллект становится ключевой рабочей нагрузкой для большинства предприятий, возникает острая необходимость в прозрачных и стандартизированных инструментах. Разработчикам требуется гибкость в распределении вычислительных мощностей без жесткой привязки к закрытым программным экосистемам.

Изображение из источника

Передача драйвера DRA предоставляет разработчикам ряд технических преимуществ. Во-первых, это улучшенная эффективность: драйвер обеспечивает умное разделение ресурсов GPU с поддержкой технологий многопроцессного обслуживания (Multi-Process Service) и разделения графического процессора на несколько независимых экземпляров (Multi-Instance GPU).

Во-вторых, драйвер нативно поддерживает технологию межкомпонентных соединений NVLink. Это критически важно для объединения систем при обучении массивных моделей искусственного интеллекта на архитектуре нового поколения, такой как Grace Blackwell.

Кроме того, на конференции KubeCon Europe 2026 NVIDIA представила поддержку GPU для Kata Containers — легковесных виртуальных машин, обеспечивающих строгую изоляцию рабочих нагрузок. Это открывает путь к конфиденциальным вычислениям, позволяя запускать ИИ-модели с повышенным уровнем защиты данных.

Дополнительно планировщик высокопроизводительных нагрузок KAI Scheduler был принят в качестве проекта песочницы (Sandbox) CNCF, а также анонсирован Grove — открытый программный интерфейс (API) для оркестрации ИИ-нагрузок в кластерах.

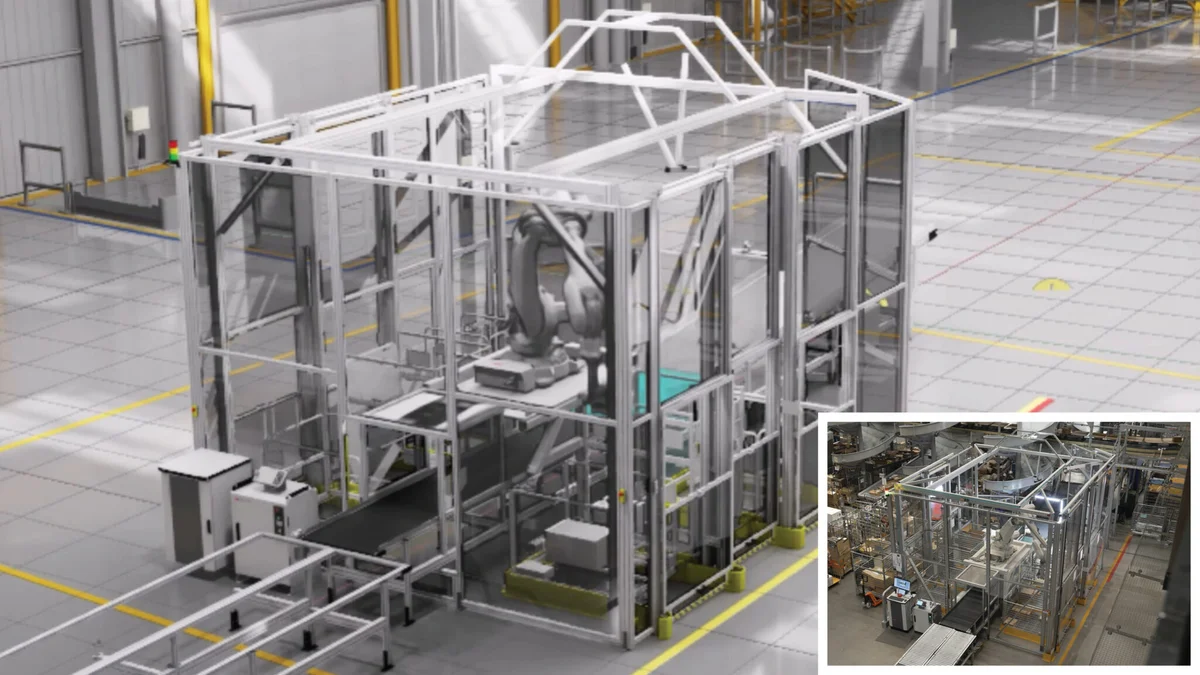

ABB Robotics Taps NVIDIA Omniverse to Deliver Industrial‑Grade Physical AI at Scale

Решение NVIDIA передать ключевые программные компоненты в открытый исходный код (open source) демонстрирует глубокое понимание рыночной динамики. Компания осознает, что для дальнейшего роста продаж аппаратного обеспечения необходимо максимально снизить порог входа для его использования.

Стандартизация программной инфраструктуры вокруг Kubernetes и CNCF снижает опасения корпоративных клиентов по поводу жесткой привязки к поставщику (vendor lock-in) на уровне оркестрации. Когда базовые инструменты управления становятся открытыми, экосистема развивается быстрее. В проекте уже участвуют такие гиганты, как Amazon Web Services, Google Cloud, Microsoft и Red Hat, что гарантирует широкую совместимость и поддержку.

В ближайшем будущем мы увидим более тесную интеграцию ИИ-нагрузок с традиционной облачной инфраструктурой (cloud-native). Управление кластерами GPU станет таким же рутинным процессом, как сегодня управление обычными серверами.

Анонс таких проектов, как OpenShell для безопасного запуска автономных агентов и системы NVSentinel для устранения сбоев, указывает на следующий этап развития индустрии. Фокус смещается с простого запуска моделей на обеспечение безопасности, отказоустойчивости и управляемости сложных систем агентов искусственного интеллекта в распределенных средах.

NVIDIA передала драйвер распределения ресурсов GPU фонду CNCF, делая управление ИИ-инфраструктурой в Kubernetes открытым и стандартизированным.

NVIDIA добровольно отказывается от монополии на программное обеспечение для оркестрации, понимая, что открытые стандарты ускорят развертывание ИИ и, как следствие, увеличат спрос на их аппаратное обеспечение.