Суть

Компания OpenAI объявила о расширении программы доверенного доступа (Trusted Access for Cyber, TAC) и запуске новых моделей: GPT-5.5 и специализированной GPT-5.5-Cyber. Главная цель инициативы — предоставить верифицированным специалистам по кибербезопасности инструменты без стандартных потребительских ограничений. Это позволит исследователям быстрее находить уязвимости, анализировать вредоносный код и защищать критическую инфраструктуру.

Контекст

Исторически создатели больших языковых моделей (LLM) сталкивались с дилеммой двойного назначения. Модель, способная написать код для закрытия уязвимости, с тем же успехом может написать эксплойт для ее использования. Из-за этого стандартные версии нейросетей часто отказываются выполнять легитимные запросы специалистов по безопасности, блокируя любой код, похожий на вредоносный. Недавно OpenAI опубликовала план «Кибербезопасность в эпоху интеллекта», где описала концепцию демократизации защиты на базе ИИ. Запуск новых версий GPT-5.5 — это практическая реализация данного подхода, переход от универсальных запретов к системе, основанной на доверии и идентификации.

Детали

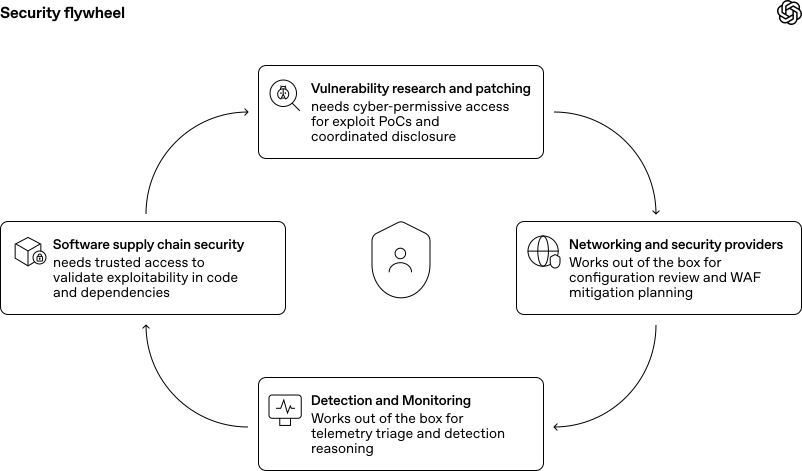

Circular “Security flywheel” diagram with four stages: vulnerability patching, network/security protection, monitoring, and supply chain security.

Теперь экосистема доступа к моделям OpenAI для задач безопасности делится на три уровня.

Первый уровень — стандартная модель GPT-5.5. Она предназначена для общих задач и имеет строгие ограничения на генерацию потенциально опасного кода.

Второй уровень — GPT-5.5 с Trusted Access for Cyber (TAC). Это основная модель для большинства специалистов. При подтверждении личности исследователя система снижает количество отказов. Модель позволяет проводить сортировку уязвимостей, реверс-инжиниринг бинарных файлов и анализ вредоносного ПО. При этом она по-прежнему блокирует попытки кражи учетных данных или эксплуатации сторонних систем.

Третий уровень — GPT-5.5-Cyber, доступная в ограниченном превью. Это наиболее открытая версия, созданная для работы красных команд (red teaming) и тестирования на проникновение (penetration testing). Она способна генерировать рабочие эксплойты и тестировать их в контролируемых средах. Например, в тестах OpenAI эта модель смогла успешно выполнить команды на тестовом сервере с уязвимостью в React.

Для получения расширенного доступа организации и специалисты обязаны использовать строгие методы аутентификации, устойчивые к фишингу. Эти требования станут обязательными с 1 июня 2026 года.

Introducing Advanced Account Security

Анализ

Важно понимать, что GPT-5.5-Cyber не превосходит базовую GPT-5.5 в интеллекте или способности к рассуждениям. Ее ключевое отличие заключается исключительно в уровне дозволенности. OpenAI не стала обучать отдельную «сверхумную» модель для хакеров, а лишь сняла искусственные барьеры безопасности для тех, кто доказал свои благие намерения.

Такой подход решает фундаментальную проблему индустрии: защитники больше не должны тратить время на обход фильтров безопасности (jailbreak) собственных рабочих инструментов. Разделение уровней доступа позволяет сбалансировать риски распространения опасных технологий и потребность профессионалов в мощных системах автоматизации.

Перспектива

В ближайшем будущем ожидается интеграция подобных моделей с продуктами крупных поставщиков систем безопасности. OpenAI уже работает с партнерами над созданием так называемого «маховика безопасности» (security flywheel). В этой парадигме ИИ помогает аналитикам мгновенно превращать информацию о новой уязвимости в правила для сетевых экранов (WAF) и патчи.

Время покажет, насколько надежной окажется система верификации специалистов. Если OpenAI удастся удержать баланс между открытостью для исследователей и защитой от злоумышленников, дифференцированный доступ на основе доверия станет индустриальным стандартом для всех передовых ИИ-лабораторий.