Суть

Компания OpenAI представила обновленный взгляд на Model Spec — публичный свод правил, определяющий поведение ее моделей искусственного интеллекта. Этот документ описывает, как ИИ должен следовать инструкциям, разрешать конфликты между запросами и соблюдать баланс между свободой пользователя и безопасностью. По сути, это открытая архитектура принятия решений для нейросетей, которая позволяет обществу понять, чего именно разработчики требуют от своих систем.

Контекст

По мере того как большие языковые модели (LLM) становятся мощнее и интегрируются в повседневную жизнь, скрывать принципы их работы внутри закрытых лабораторий становится невозможным. Общество, регуляторы и разработчики требуют прозрачности.

Ранее правила поведения моделей были зашиты в недрах процессов обучения и скрытых системных промптов. Model Spec выводит эти правила в публичную плоскость. Документ работает в связке с другими инициативами OpenAI: если Preparedness Framework оценивает риски передовых технологий, то Model Spec отвечает на повседневный вопрос — как именно ИИ должен вести себя в конкретном диалоге с пользователем.

OAI Monitoring internal deployments for loss of control risks Art Card 1x1

Детали

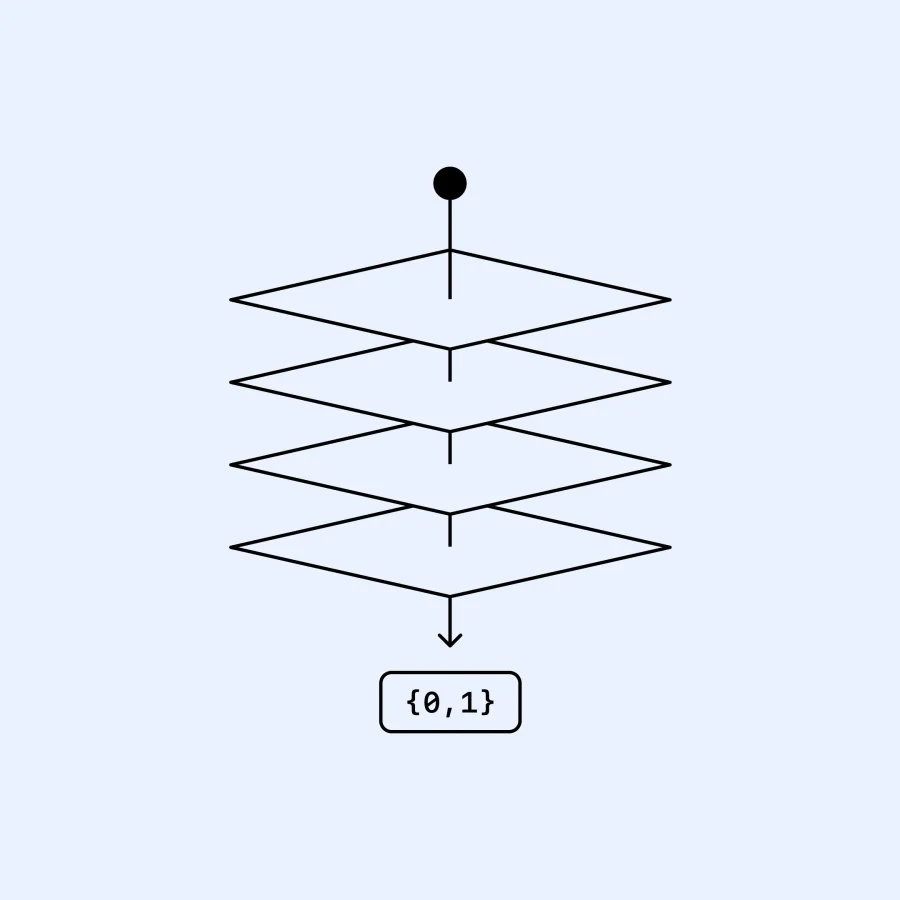

Структура Model Spec базируется на нескольких ключевых компонентах, которые помогают модели принимать решения в сложных ситуациях.

Цепочка инстанций (Chain of Command)

Это ядро документа. Модель постоянно получает инструкции из разных источников: от самой OpenAI, от разработчика приложения и от конечного пользователя. Часто эти инструкции конфликтуют. Цепочка инстанций присваивает каждому источнику свой уровень авторитета. При возникновении конфликта модель отдает приоритет инструкциям с более высоким статусом.

Жесткие правила (Hard rules)

Это системные ограничения, которые не могут быть отменены ни пользователем, ни разработчиком. Они носят запретительный характер и касаются реальных угроз: запрет на помощь в создании оружия, предотвращение физического вреда, соблюдение законов и защита несовершеннолетних. OpenAI приравнивает базовые модели к фундаментальной инфраструктуре вроде интернета, поэтому накладывает лишь те ограничения, которые критически необходимы для безопасности.

Базовые настройки (Defaults)

Это отправная точка модели — то, как она ведет себя, если не получила иных указаний. Базовые настройки обеспечивают предсказуемость. Например, по умолчанию модель стремится к объективности и использует нейтральный тон. Однако эти настройки можно переопределить. Если пользователь просит ИИ общаться в саркастичной манере или занять определенную позицию в споре, модель подчинится, так как свобода пользователя здесь ставится выше базовых рекомендаций по стилю.

Safety research the challenge > Cover Image

Анализ

Публикация и развитие Model Spec демонстрирует важный сдвиг в философии OpenAI. Компания прямо заявляет, что не хочет быть глобальным моральным арбитром.

Вместо того чтобы заставлять модель оценивать каждый запрос через призму абстрактного "блага для общества", OpenAI создает четкую правовую систему для ИИ. Если запрос пользователя не нарушает жесткие границы безопасности (например, не ведет к насилию), модель обязана его выполнить, даже если он нарушает базовые представления о вежливости. Это решение защищает интеллектуальную свободу и предотвращает концентрацию идеологического контроля в руках одной корпорации.

Перспектива

Model Spec — это не описание того, как модели OpenAI идеально работают прямо сейчас. Это заявленная цель, к которой компания стремится через процессы обучения и оценки.

В будущем этот документ будет постоянно меняться на основе обратной связи от пользователей и исследователей. Подобный итеративный подход дает обществу время на адаптацию и позволяет выстроить надежные механизмы контроля до того, как индустрия вплотную приблизится к созданию сильного искусственного интеллекта (AGI).