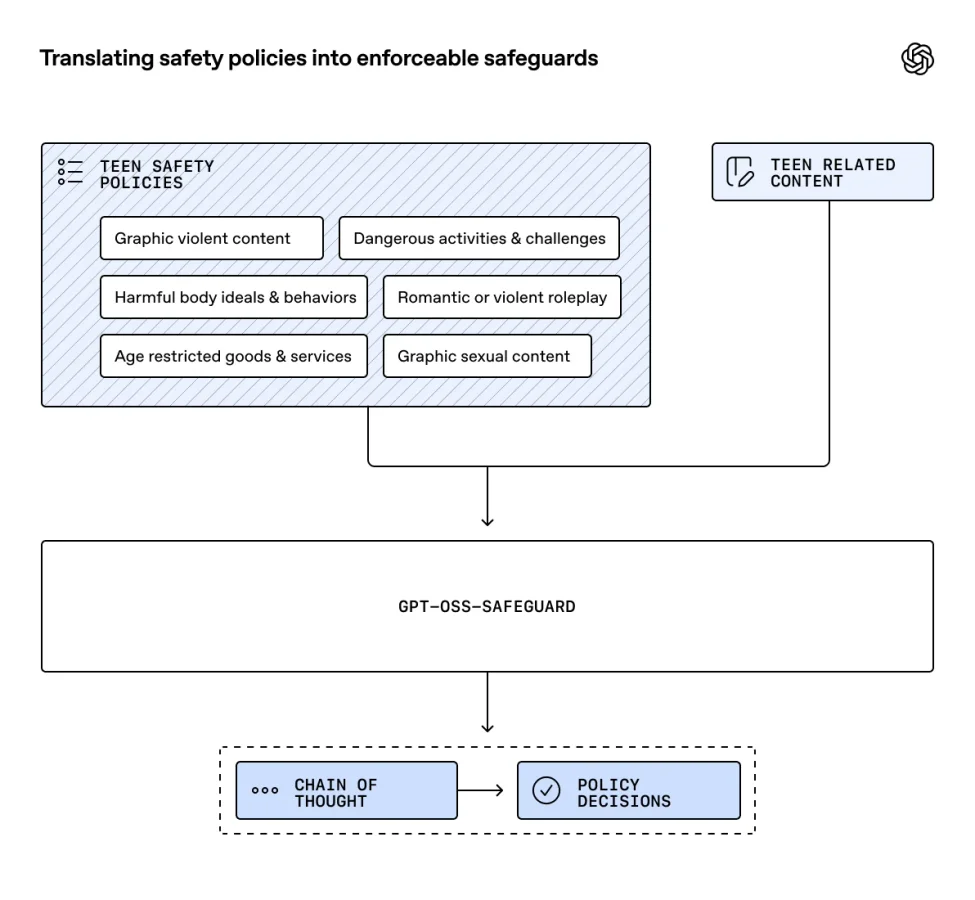

Сегодня индустрия искусственного интеллекта делает важный шаг в сторону стандартизации безопасности. Компания OpenAI выпустила набор политик безопасности, специально разработанных для защиты подростков. Эти правила представлены в формате промптов (подсказок) и предназначены для использования с открытой моделью безопасности gpt-oss-safeguard. Данное решение помогает разработчикам превратить абстрактные требования безопасности в рабочие классификаторы для реальных систем.

Безопасность молодых пользователей всегда была сложной задачей при разработке цифровых продуктов. Подростки и взрослые имеют разные потребности, и к контенту для несовершеннолетних предъявляются более строгие требования. Ранее разработчики сталкивались с серьезной проблемой: как перевести высокоуровневые принципы безопасности в точные, операционные правила для алгоритмов.

Часто это приводило к пробелам в защите, непоследовательной модерации или, наоборот, к чрезмерно жесткой фильтрации. Создание эффективных систем требовало глубоких знаний как в возрастной психологии, так и в инженерии искусственного интеллекта. Многие команды были вынуждены создавать правила модерации с нуля.

Diagram depicting teen safety policy categories and teen-related content feeding into a GPT-OSS safeguard system, which produces policy decisions informed by internal reasoning.

Чтобы решить эту проблему, OpenAI в сотрудничестве с внешними экспертными организациями, такими как Common Sense Media и everyone.ai, разработала готовые шаблоны политик. Начальная версия охватывает шесть ключевых категорий рисков:

- Сцены жестокости и насилия.

- Откровенный сексуальный контент.

- Пропаганда нездоровых идеалов тела и поведения.

- Опасные активности и челленджи.

- Романтические или жестокие ролевые игры.

- Товары и услуги с возрастными ограничениями.

Политики структурированы как промпты, которые можно напрямую загружать в gpt-oss-safeguard и другие модели, способные к рассуждению. Это позволяет использовать их как для фильтрации контента в реальном времени, так и для офлайн-анализа пользовательских данных.

Launching Sora responsibly art card 1 x 1

Этот релиз имеет большое значение для экосистемы разработчиков. Предоставляя готовые, проверенные экспертами промпты, OpenAI задает базовый уровень безопасности для всей индустрии. Разработчикам больше не нужно тратить месяцы на формулирование правил модерации для молодежи.

Использование открытой модели gpt-oss-safeguard способствует демократизации доступа к инструментам безопасности. Это позволяет даже небольшим командам внедрять надежные механизмы защиты без огромных затрат на разработку собственных классификаторов и сбор размеченных данных.

Важно понимать, что выпущенные политики — это отправная точка, а не исчерпывающее решение всех проблем. OpenAI подчеркивает необходимость эшелонированной защиты (defense in depth), которая должна включать продуманный дизайн продуктов, прозрачность, родительский контроль и системы мониторинга.

Политики опубликованы в открытом доступе через сообщество ROOST Model Community на платформе GitHub. Это означает, что разработчики со всего мира смогут адаптировать их под специфику своих приложений, переводить на другие языки и расширять для новых категорий рисков. В долгосрочной перспективе такой совместный подход open-source сообщества поможет создать более надежный и универсальный фундамент для безопасного взаимодействия подростков с технологиями искусственного интеллекта.