Суть

Компания OpenAI представила новую модель GPT-5.5, которая стала вычислительной основой для обновленного агентного приложения Codex. NVIDIA уже развернула эту систему внутри компании для более чем 10 тысяч своих сотрудников. Это событие представляет собой важный прецедент для индустрии: мы наблюдаем переход от экспериментального использования ИИ-агентов к их масштабному применению в сложных корпоративных процессах, где агенты способны автономно обрабатывать информацию и решать многоуровневые задачи.

Контекст

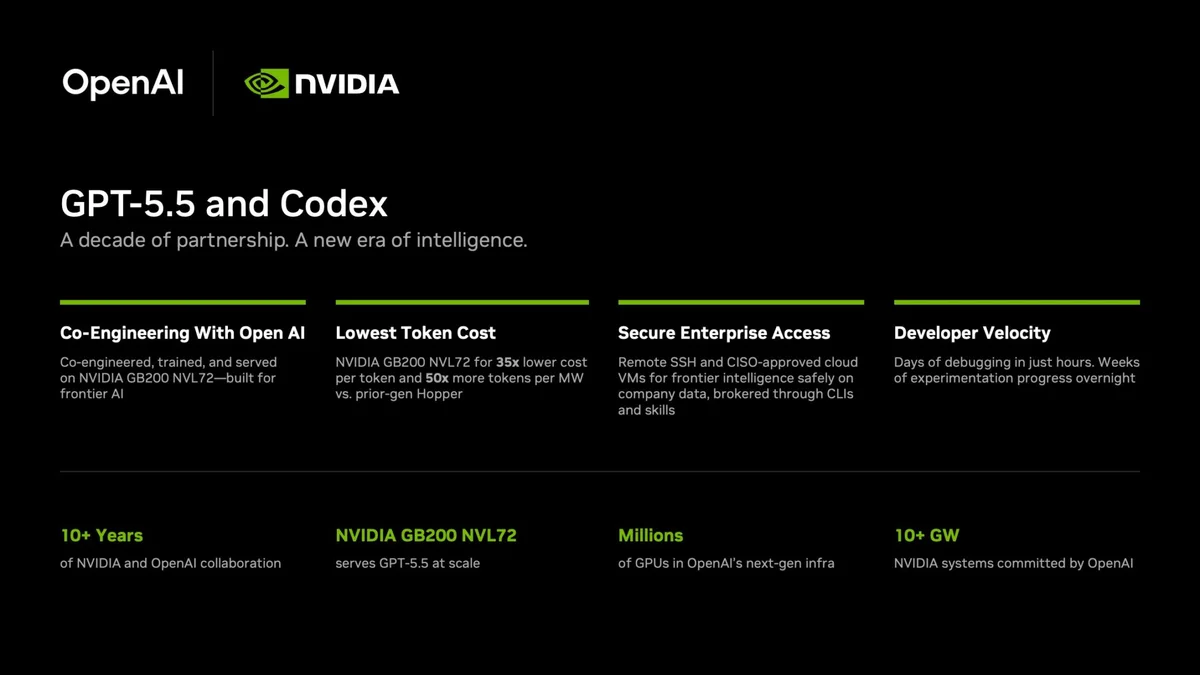

Сотрудничество между NVIDIA и OpenAI имеет глубокие корни и продолжается более десяти лет. Еще в 2016 году OpenAI получила первый ИИ-суперкомпьютер DGX-1. Сегодня партнерство вышло на уровень совместного проектирования аппаратного обеспечения и инфраструктуры. Компании успешно запустили первый вычислительный кластер, состоящий из 100 000 графических процессоров (GPU) на базе стоечных систем GB200 NVL72. Именно эта инфраструктура обеспечила необходимую мощность для создания и последующей работы модели GPT-5.5.

Детали

Масштабное внедрение Codex внутри NVIDIA затронуло не только инженеров, но и специалистов из юридического, финансового, маркетингового и кадрового отделов. Внутренние данные показывают существенное ускорение рабочих процессов: циклы отладки сложного кода сократились с нескольких дней до часов, а проверка гипотез, ранее требовавшая недель, теперь выполняется за ночь.

Ключевым фактором, сделавшим такое масштабное внедрение возможным, стала экономика вычислений. Использование систем GB200 NVL72 позволило снизить стоимость обработки миллиона токенов в 35 раз. Одновременно с этим пропускная способность генерации токенов в расчете на один мегаватт энергии выросла в 50 раз по сравнению с системами предыдущего поколения.

Для обеспечения корпоративной безопасности ИТ-подразделение NVIDIA разработало строгую архитектуру развертывания. Каждый агент работает в выделенной облачной виртуальной машине (VM), доступ к которой осуществляется через защищенное соединение (SSH). Система функционирует в рамках политики нулевого сохранения данных (zero-data retention), а доступ к производственным системам ограничен правами только на чтение.

Rethinking AI TCO: Why Cost per Token Is the Only Metric That Matters

Анализ

Эти данные указывают на решение одной из главных проблем масштабирования искусственного интеллекта — высокой стоимости вывода (inference). Долгое время затраты на вычисления делали нерентабельным использование ИИ в качестве автономных агентов, поскольку для решения одной задачи агент генерирует огромное количество промежуточных токенов, анализируя контекст и планируя действия. Кардинальное снижение стоимости вычислений и рост энергоэффективности открывают дорогу для повсеместного внедрения агентных систем в крупном бизнесе.

Перспектива

Заявление OpenAI о планах по развертыванию будущей инфраструктуры на базе систем NVIDIA мощностью более 10 гигаватт показывает, что текущие изменения — лишь начальный этап. В ближайшие годы фокус индустрии окончательно сместится с диалоговых систем на полноценных цифровых помощников, способных безопасно взаимодействовать с корпоративными базами данных и выполнять многодневные задачи. Время покажет, насколько быстро другие крупные корпорации смогут адаптировать этот опыт, но технологический фундамент для эры ИИ-агентов уже заложен.