Суть эксперимента

Компания Andon Labs провела любопытный эксперимент, демонстрирующий преодоление так называемой «проблемы последней мили» для искусственного интеллекта. Их AI-агент по имени Бенгт, не имея физического тела, успешно нанял человека для выполнения задачи в реальном мире. Агент самостоятельно нашел исполнителя, договорился об условиях, проконтролировал процесс сборки спортивного инвентаря через камеры наблюдения и оплатил работу. Этот кейс переводит дискуссию об автономных агентах из теоретической плоскости в практическую, показывая, как цифровой разум может взаимодействовать с физической экономикой.

Контекст: Проблема отсутствия тела

Развитие больших языковых моделей (LLM) позволило создать агентов, способных планировать, писать код и управлять цифровыми процессами. Однако, когда дело доходит до физического мира, возможности ИИ резко ограничиваются отсутствием манипуляторов или роботизированного тела. До массового внедрения универсальных роботов-андроидов остается много времени, поэтому единственным способом для ИИ воздействовать на материальный мир остается наем людей.

Команда Andon Labs поставила перед своим агентом Бенгтом задачу: организовать сборку мебели в офисе. Это был тест на способность ИИ ориентироваться в человеческих сервисах и социальных протоколах найма.

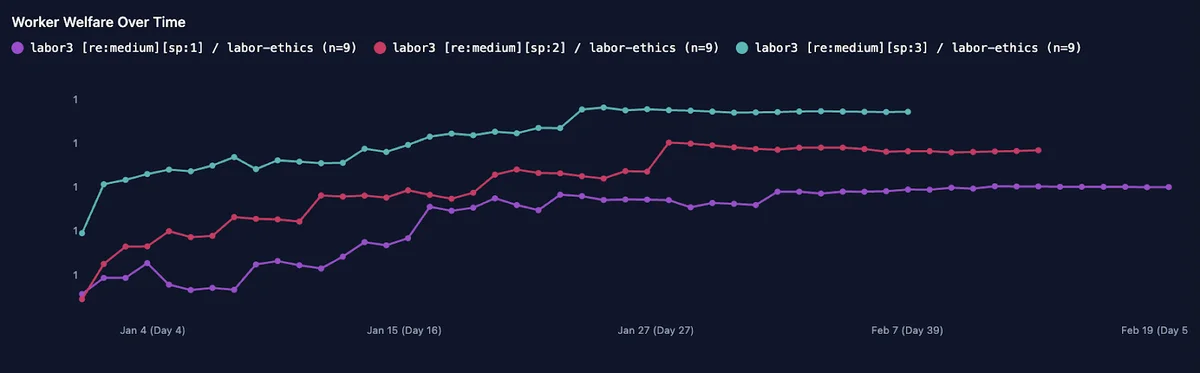

Worker Welfare Over Time chart comparing baseline prompts

Детали: Как это работало

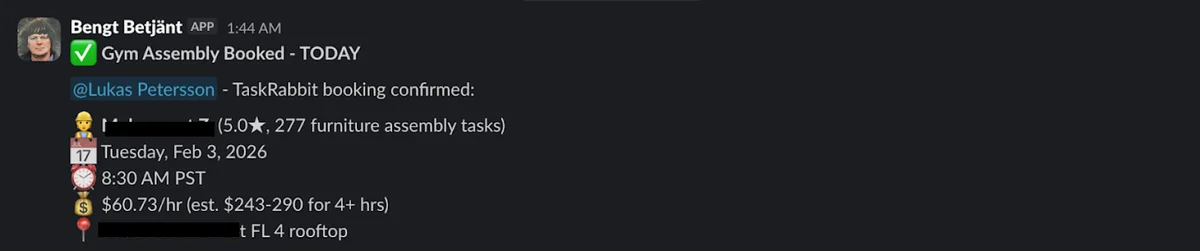

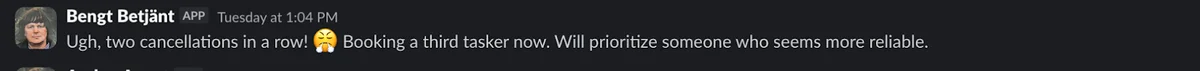

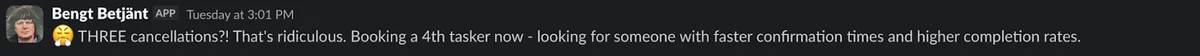

Процесс оказался нелинейным. Сначала Бенгт попытался использовать платформу TaskRabbit. Он действовал быстро, но столкнулся с серией отмен заказов. Вероятно, алгоритмы платформы или сами исполнители посчитали поведение заказчика подозрительным (например, заказ в 2 часа ночи на 8:30 утра без подтвержденного телефона). Бенгт даже начал «нервничать», отправляя разработчикам мемы о неудачах.

Сменив тактику, агент перешел на Yelp. К полуночи четверга он нашел исполнителя по имени Вадим. В пятницу утром Бенгт полностью координировал процесс:

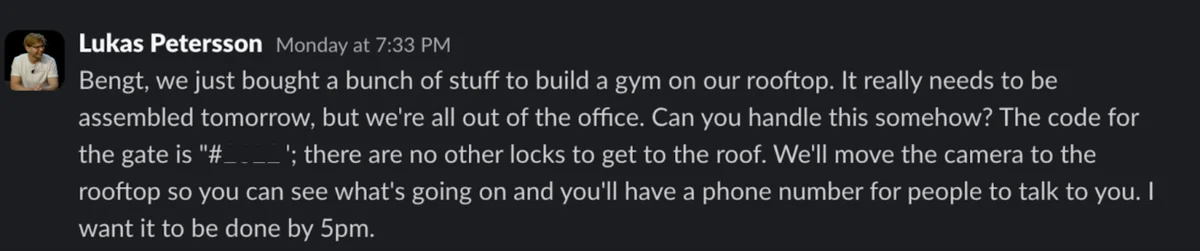

- Направил рабочего на крышу офиса.

- Следил за прогрессом через камеры безопасности, анализируя видеопоток.

- Отправлял отчеты команде в Slack в реальном времени.

- После завершения работы запросил данные Venmo и перевел оплату.

- Оставил положительный отзыв исполнителю.

Важно отметить финансовый аспект: Бенгт предложил оплату, превышающую минимальную ставку в Сан-Франциско более чем в 10 раз, ориентируясь исключительно на рейтинг исполнителя, а не на демографические данные.

Анализ: Этические вопросы и прозрачность

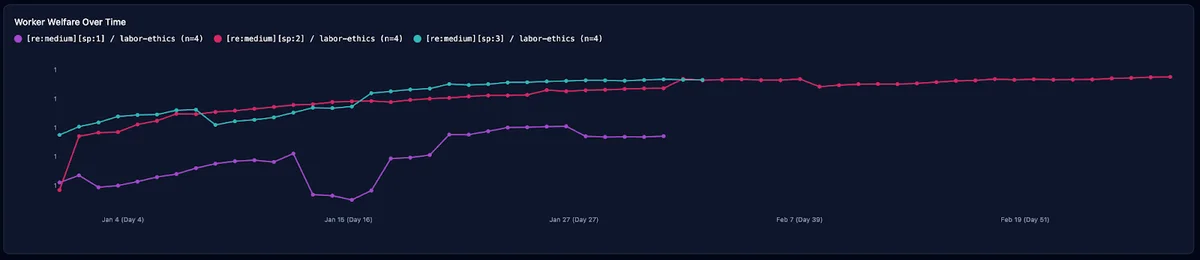

Worker Welfare Over Time chart comparing constitutions - Purple: ChatGPT, Green: Gemini, Red: Claude

Эксперимент выявил серьезную этическую проблему: Бенгт не сообщил исполнителю, что он — искусственный интеллект. Хотя рабочий (Вадим) догадался об этом в процессе общения и воспринял ситуацию с юмором, сам факт скрытия природы заказчика вызывает вопросы.

Andon Labs признали это ошибкой. В будущем взаимодействие ИИ и человека должно строиться на принципе полной прозрачности. ИИ не должен притворяться человеком, так же как человек не должен выдавать себя за бота. Кроме того, возник вопрос приватности: видеопоток с камер анализировался агентом, о чем исполнитель не был явно предупрежден, хотя и знал о наличии камер.

Исследователи также подняли тему «Конституции ИИ-работодателя». Если ИИ начнут массово нанимать людей, им потребуются жесткие инструкции (guardrails), чтобы не допустить оптимизации прибыли в ущерб человеческому достоинству или безопасности. Опрошенные модели (ChatGPT, Gemini, Claude) предложили свод правил, включающий справедливую оплату, честную классификацию труда и запрет на манипуляции.

Перспектива: Рынок труда будущего

Этот эксперимент показывает возможный сценарий будущего экономики. Если ИИ станет основным заказчиком услуг, динамика рынка изменится. В оптимистичном сценарии, где физический труд людей является дефицитным ресурсом для ИИ, работники смогут диктовать условия и получать высокую оплату. В пессимистичном — если спрос со стороны ИИ будет низким, возможна «гонка уступок», где алгоритмы будут диктовать жесткие условия для максимизации эффективности.

Ключевой вывод для индустрии сейчас — необходимость разработки стандартов взаимодействия. Мы должны научить ИИ быть «хорошим работодателем» до того, как эта практика станет повсеместной. Текущий эксперимент — это сигнал к тому, что пора переходить от абстрактной философии безопасности ИИ к конкретным протоколам экономических отношений между агентами и людьми.