Феномен «workslop»: почему сотрудники генерируют бесполезный AI-контент и как это остановить

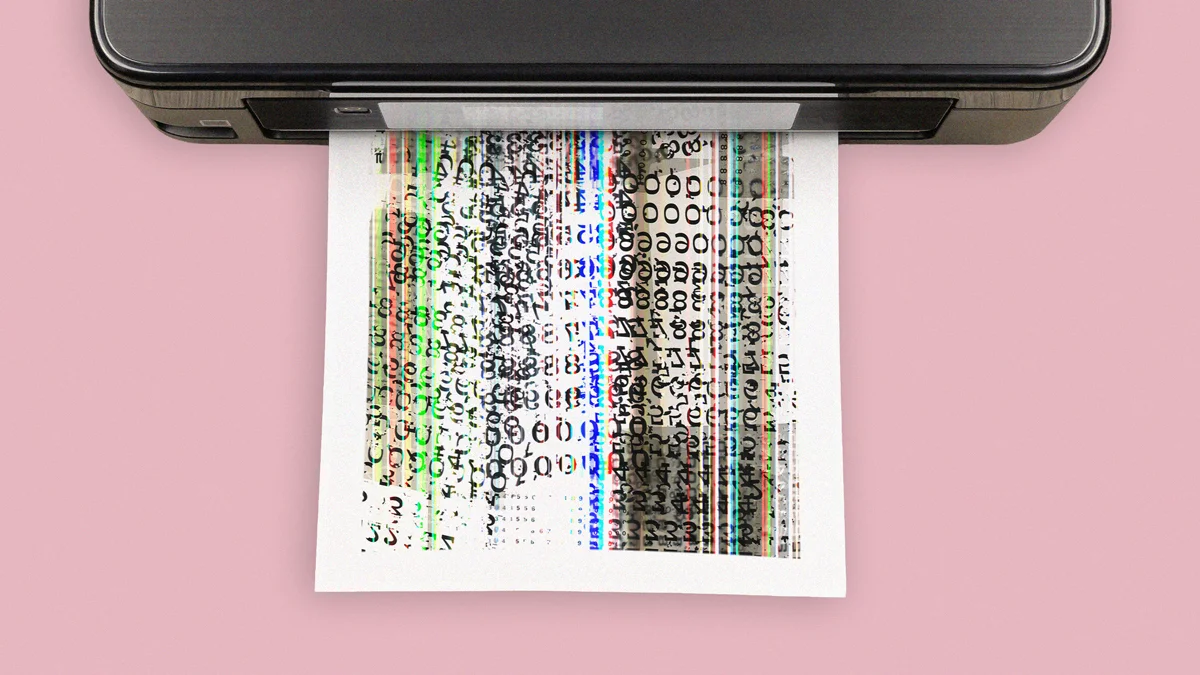

Компании сталкиваются с новой проблемой: сотрудники массово используют AI для создания внешне качественной, но пустой работы, перекладывая когнитивную нагрузку на коллег.

С ростом популярности генеративного искусственного интеллекта офисы столкнулись с новым вызовом, который исследователи Harvard Business Review назвали «workslop» (от англ. work + slop, «рабочие помои»). Это низкокачественная работа, выполненная с помощью AI, которая выглядит правдоподобно и отполировано, но по сути является пустой тратой времени. Главная проблема такого контента в том, что он перекладывает когнитивную нагрузку с создателя на получателя: коллегам и руководителям приходится тратить усилия, чтобы продраться через сгенерированный текст и понять, есть ли в нем смысл.

Почему возникает «workslop»?

Исследования показывают, что сотрудники создают такой контент не из злого умысла или лени. Причина кроется в сочетании двух факторов, находящихся под контролем менеджмента:

- Нечеткие мандаты на использование AI. Руководство часто спускает сверху размытые директивы: «Начните использовать эти мощные инструменты», не объясняя, где именно, как и для каких задач. Это создает давление без ясности.

- Перегруженность команд. Сотрудники, находящиеся в состоянии выгорания или психологического истощения, используют AI как спасательный круг, чтобы просто закрыть задачу, не вникая в качество результата.

Коррозия корпоративной культуры