Суть исследования

Развитие больших языковых моделей (LLM) привело к появлению нового класса инструментов — агентов использования компьютера (Computer Use Agents). Эти системы способны выполнять команды пользователя, взаимодействуя с интерфейсом операционной системы или браузера: нажимать кнопки, прокручивать страницы и заполнять формы. Однако до сих пор индустрия фокусировалась преимущественно на технической реализации и бенчмарках производительности, оставляя без внимания вопрос: как именно люди хотят взаимодействовать с такими помощниками?

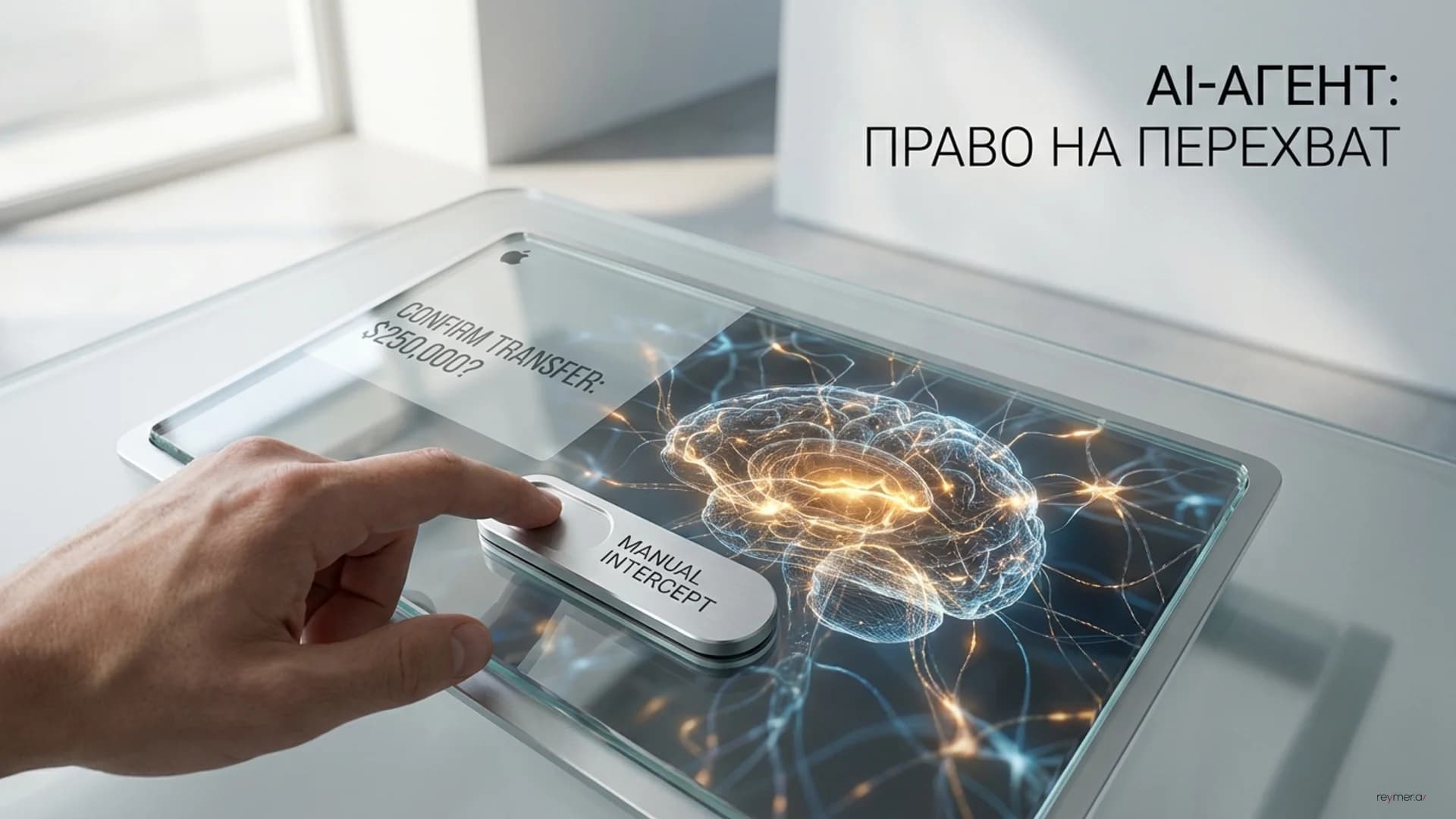

Исследователи из Apple и Университета Карнеги-Меллона опубликовали работу, в которой попытались закрыть этот пробел. Они разработали таксономию (систему классификации) пользовательского опыта для подобных агентов. Главный вывод работы заключается в том, что простого выполнения задач недостаточно. Пользователям критически важны прозрачность действий агента, возможность перехвата управления в любой момент и понятная ментальная модель того, как агент «думает».

Контекст

Идея программных агентов, управляющих интерфейсом, не нова. В сообществе взаимодействия человека и компьютера (HCI) эти концепции обсуждаются десятилетиями. Ранние примеры, такие как CoScripter или ScriptAgent, позволяли записывать и воспроизводить действия. Однако современные LLM и мультимодальные модели (MLLM) вывели эту технологию на новый уровень автономности.

Сегодня мы видим такие проекты, как «Computer Use» от Anthropic, OpenWebAgent и различные реализации от Apple (например, Ferret-UI). Проблема в том, что большинство исследований сосредоточено на точности выполнения задач. Но, как отмечали пионеры HCI еще в 90-х годах, агенты не должны быть полной альтернативой прямому управлению. Баланс между автономией машины и контролем человека остается сложной инженерной и дизайнерской задачей, которая с приходом мощных нейросетей стала только острее.

Детали эксперимента

Исследование проходило в два этапа. Сначала авторы проанализировали девять существующих систем компьютерных агентов, выпущенных в 2024–2025 годах, и провели интервью с восемью практиками в области UX и AI. Это позволило создать начальную карту пространства дизайна, выделив ключевые категории: подсказки пользователя (prompts), объяснимость действий, контроль и ментальные модели.

На втором этапе была проведена валидация через метод «Волшебник страны Оз» (Wizard-of-Oz). В этом эксперименте 20 участников взаимодействовали с веб-агентом, роль которого исполнял человек-исследователь. Участники выполняли задачи в трех сценариях:

- Нормальное выполнение — агент работает корректно.

- С ошибками — агент совершает неверные действия, требуя вмешательства.

- Рискованное выполнение — задачи, где цена ошибки высока (например, финансовые операции).

Такой подход позволил выявить реальные реакции пользователей на поведение системы, не ограничиваясь текущими техническими несовершенствами реальных моделей.

Анализ результатов

Результаты исследования показывают, что доверие к агентам строится не только на успешном завершении задачи. Пользователям важно понимать, почему агент совершает то или иное действие. Объяснимость (explainability) становится критическим фактором UX. Если агент просто молча двигает курсор, это вызывает тревогу, особенно в рискованных сценариях.

Другой важный аспект — передача контроля. Пользователи хотят иметь возможность мгновенно остановить агента или скорректировать его действия, не прерывая весь процесс. Это требует переосмысления интерфейсов: они должны поддерживать гибридный режим, где человек и AI работают совместно, а не последовательно.

Также выяснилось, что у пользователей часто формируются неверные ментальные модели возможностей агента. Они либо переоценивают его интеллект, ожидая человеческой интуиции, либо недооценивают, пытаясь давать слишком примитивные команды. Дизайн интерфейса должен активно управлять этими ожиданиями.

Перспектива

Данная работа закладывает фундамент для стандартов проектирования будущих операционных систем и приложений. Мы движемся к парадигме, где интерфейс перестает быть статичным набором кнопок и становится динамической средой сотрудничества.

В ближайшем будущем разработчикам придется внедрять механизмы «прозрачности мыслей» агентов прямо в UI. Вероятно, мы увидим появление новых визуальных паттернов, показывающих намерения AI до совершения действия (например, подсветка кнопки перед нажатием). Это исследование — сигнал для индустрии: гонка за мощностью моделей должна сопровождаться столь же интенсивной работой над эргономикой их использования, иначе даже самый умный агент останется непригодным для реальной работы.