Защита данных в эпоху агентов: OpenAI вводит режим изоляции и маркировку рисков

OpenAI представляет Lockdown Mode для защиты от промпт-инъекций и утечки данных, а также вводит маркировку функций с повышенным риском для корпоративных пользователей.

Суть: Безопасность превыше функциональности

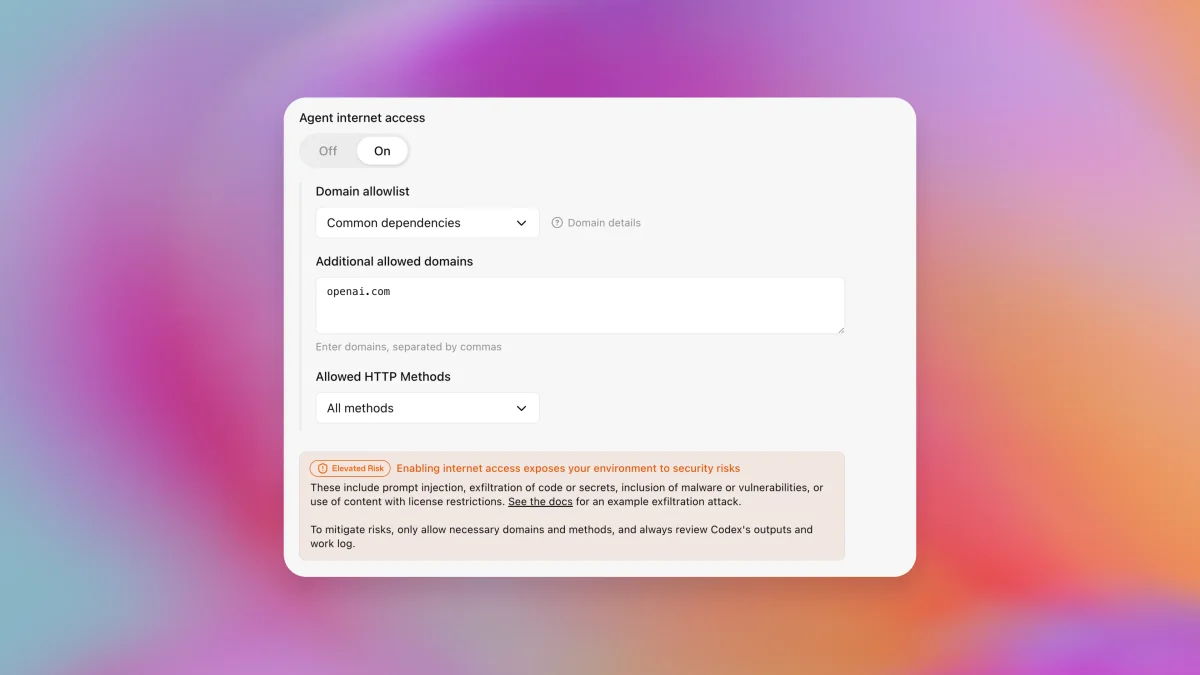

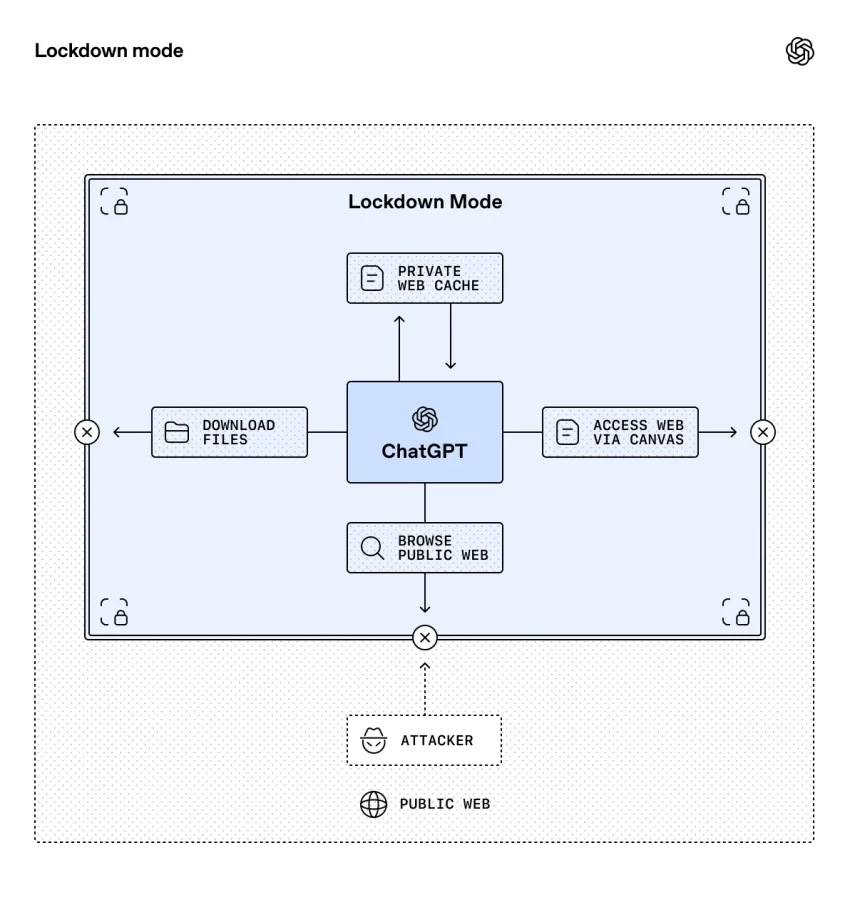

OpenAI объявила о внедрении двух важных механизмов защиты в экосистему ChatGPT: режима изоляции (Lockdown Mode) и маркировки функций повышенного риска (Elevated Risk labels). Это обновление, датированное февралем 2026 года, направлено на решение одной из самых сложных проблем в безопасности больших языковых моделей — защиты от промпт-инъекций (prompt injection) и предотвращения скрытой утечки данных.

По сути, компания признает, что по мере того, как ИИ-системы получают доступ к интернету и сторонним приложениям, риски эксплуатации этих связей возрастают. Новые инструменты дают администраторам и пользователям возможность сознательно ограничивать функциональность моделей ради гарантированной безопасности данных.

Контекст: Эволюция угроз

Долгое время основной угрозой для языковых моделей считалась генерация токсичного контента. Однако с появлением агентских систем, способных выполнять действия в интернете и подключаться к корпоративным базам данных, вектор атак изменился. Промпт-инъекции — это метод, при котором злоумышленник скрывает инструкции внутри текста (например, на веб-странице или в документе), заставляя ИИ выполнить вредоносное действие, например, отправить конфиденциальные данные на сервер хакера.

Diagram titled “Lockdown mode” showing ChatGPT inside a secured boundary with connections to a Private Web Cache, Download Files, Access Web via Canvas, and Browse Public Web. An external “Attacker” and the Public Web are depicted outside the boundary, with blocked entry points indicating restricted access in lockdown mode.