Сегодня мы наблюдаем важный переход индустрии от простых диалоговых систем к автономным агентам. Этот процесс требует переосмысления того, как мы управляем технологиями, защищаем их и оцениваем стоимость.

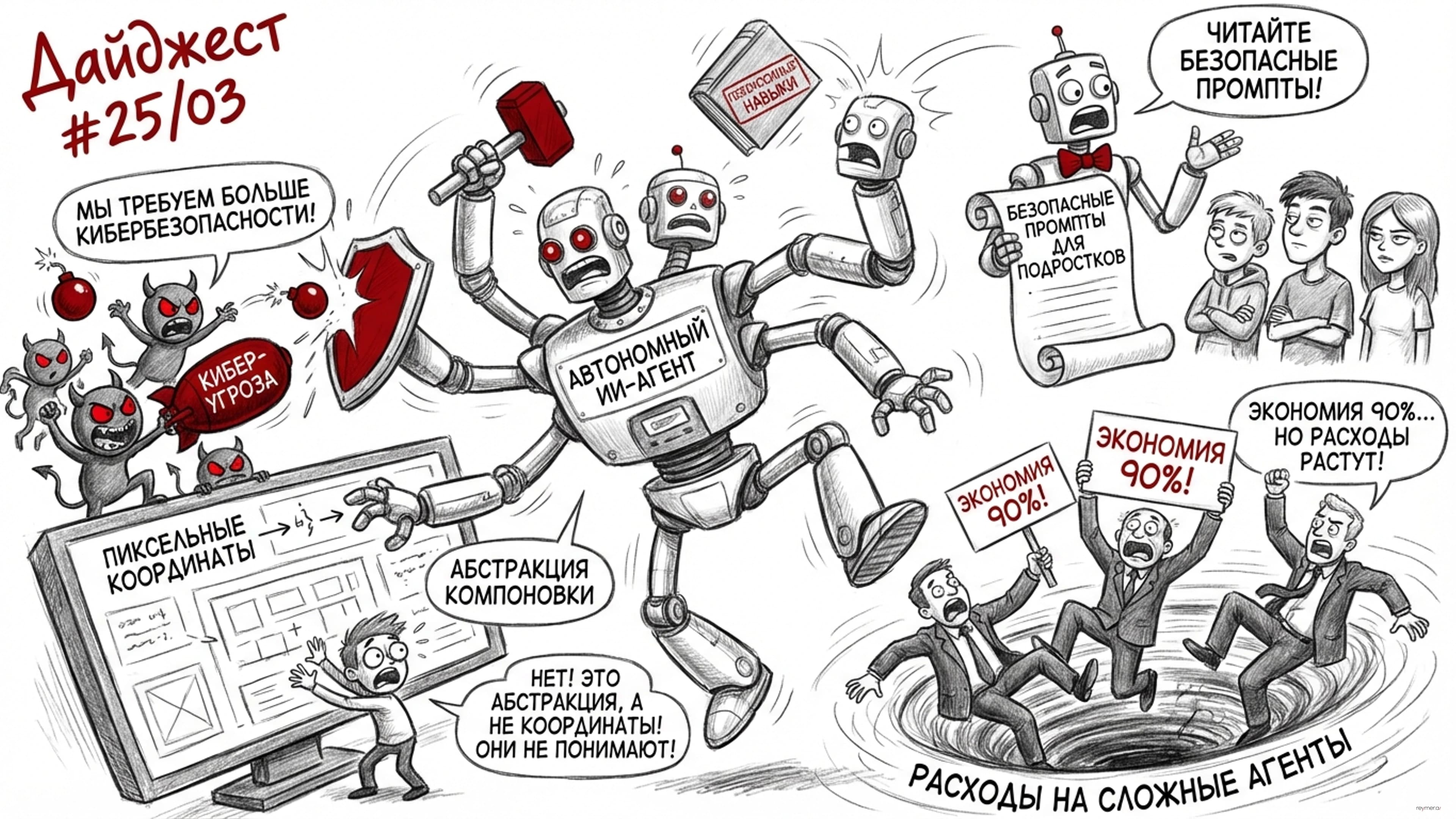

Согласно прогнозу Gartner, к 2030 году стоимость базовых вычислений для языковых моделей снизится на 90 процентов. Однако общие расходы компаний возрастут. Причина в том, что многоступенчатые агентные системы потребляют кратно больше токенов для решения сложных задач, нивелируя экономию на инфраструктуре. Усложнение алгоритмов диктует новые правила экономики.

Возрастающая самостоятельность агентов неизбежно порождает новые риски. Традиционные модели контроля доступа перестают работать, когда система действует без прямого участия человека. В связи с этим защита автономных ИИ-систем формирует новый масштабный рынок кибербезопасности, требующий специализированных ИИ-файрволов. На фоне корпоративных вызовов развиваются и стандарты социальной ответственности. Новые политики безопасности OpenAI помогают защитить юных пользователей, переводя абстрактные этические нормы в формат конкретных, открытых для сообщества системных инструкций.

Параллельно меняется сама парадигма взаимодействия с моделями — работа с контекстом становится все более похожей на классическую разработку программного обеспечения. Платформа LangSmith Fleet внедряет систему общих навыков, позволяя формализовать корпоративные знания в виде переносимых модульных блоков. Подобный структурный подход необходим и в узкоспециализированных нишах. Опыт создания агентов для визуального дизайна наглядно демонстрирует, что успех кроется в создании интерактивной среды, где сложные пиксельные координаты переводятся в понятные модели абстракции для совместной работы.

Мы видим, как искусственный интеллект постепенно лишается статуса непредсказуемого эксперимента, превращаясь в надежную инженерную дисциплину со своими правилами архитектуры, безопасности и контроля.